今日概览

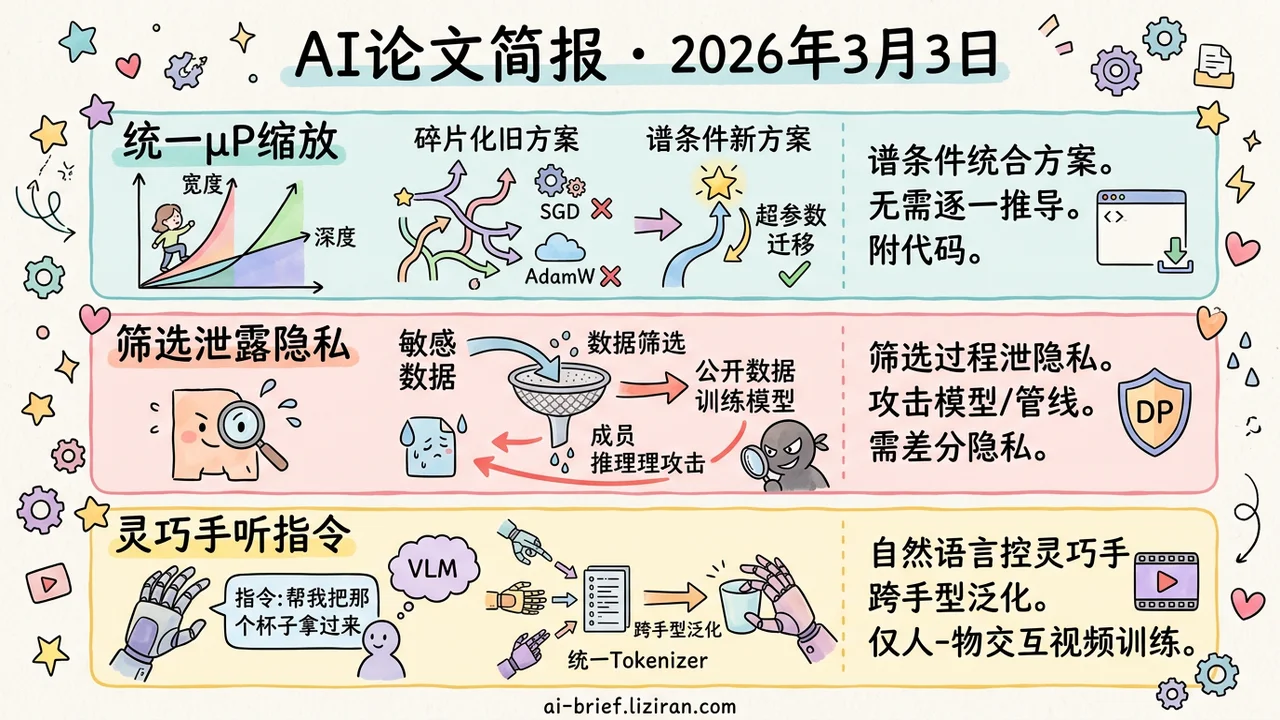

- 谱条件统一了μP的宽度-深度联合缩放,不再需要逐架构逐优化器单独推导超参数迁移规则,附带代码实现。

- 数据筛选过程本身就泄露成员信息:Anthropic研究表明,即使模型只在公开数据上训练,攻击者仍可推断原始数据集的组成。

- VLM让灵巧手听懂自然语言指令。UniHM用统一tokenizer跨手型泛化,只需人-物交互视频训练,不依赖遥操作数据。

重点关注

01 训练优化 统一的谱条件让μP同时管住宽度和深度

μP(最大更新参数化)解决了模型变宽时的超参数迁移问题,但模型同时变宽又变深时,现有方案是碎片化的——SGD一套规则,AdamW另一套,换个架构又得重新推导。这篇工作提出了一个谱条件(spectral condition),用权重矩阵的范数和每步更新量随宽度、深度的缩放关系,给出统一的约束框架。关键在于这个条件足够通用:之前针对特定优化器推导的μP公式都能作为特例被恢复,同时自然扩展到更多优化器。在GPT-2风格的语言模型上,谱μP在宽度-深度联合缩放下保持了稳定的特征学习,超参数迁移表现稳健。论文附带代码实现,这对实际要做scaling的团队来说,意味着可以从「每种配置单独调参」过渡到有理论支撑的系统化迁移。

原文:Spectral Condition for μP under Width-Depth Scaling

02 安全对齐 「只用筛选后的干净数据训练」就安全了?没那么简单

数据筛选(curation)是一种越来越流行的隐私策略:用敏感数据指导筛选,但只拿筛选后的公开数据训练模型,这样模型从未直接接触隐私数据。Anthropic的研究团队对这个假设做了系统性检验,结果是筛选管线的每个环节——评分计算、子集选择、最终模型——都会泄露原始数据集的成员信息。攻击者可以通过成员推理攻击(membership inference attack)判断某条数据是否参与了筛选过程,即使模型本身只在公开数据上训练过。好消息是,对筛选方法做差分隐私(DP)适配后,泄露可以有效缓解,说明这不是个无解的问题,而是需要把隐私保障的边界从「训练过程」扩展到「数据选择过程」。

原文:Curation Leaks: Membership Inference Attacks against Data Curation for Machine Learning

03 机器人 灵巧手操控跨过了「逐物体编程」的阶段

灵巧手操控此前有两条路线:要么针对特定物体训练策略(「抓杯子」「拧螺丝」各一套),要么预定义手-物交互序列——两种方式都难以扩展到开放场景。UniHM的思路是用VLM(视觉语言模型)理解自由形式的语言指令,再规划物理可行的手指轨迹。一个值得注意的设计是统一灵巧手tokenizer,把不同构型的机械手映射到同一个codebook,解决了跨手型泛化的问题。训练数据只用了人-物交互视频,不需要大规模遥操作采集,这在数据成本上是个实际优势。ICLR接收,在多个数据集上对未见物体也能泛化,但从摘要看评估主要还是在实验室环境,距离真实部署场景还有距离。

原文:UniHM: Unified Dexterous Hand Manipulation with Vision Language Model