今日概览

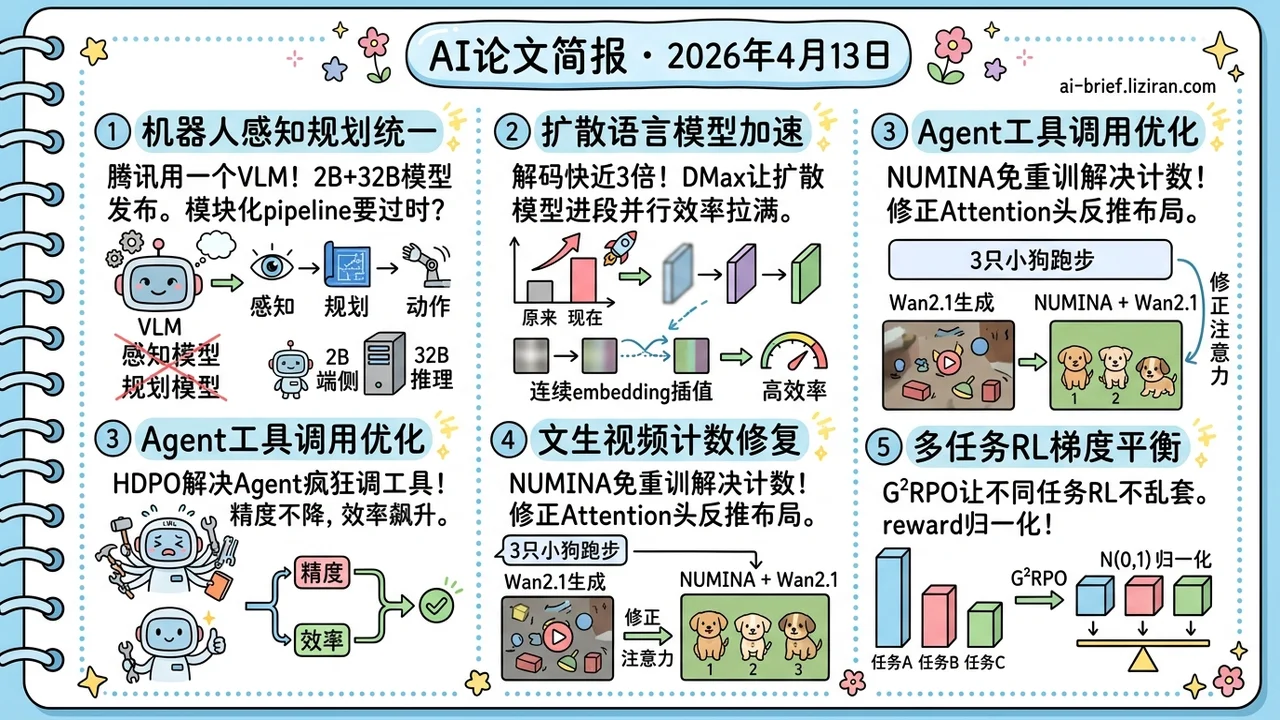

- 腾讯用一个VLM统一了机器人的感知和规划,释出2B端侧+32B推理双规格模型,模块化pipeline的复杂度优势可能不再成立

- 扩散语言模型的并行解码效率提升近3倍:DMax用连续embedding插值替代二值跳变,两块H200跑到每秒1,338 token

- Agent的核心瓶颈不是工具太少,是调用太多。HDPO将精度与效率拆成正交通道,工具调用量降几个数量级而准确率不降

- 文生视频的计数问题有了training-free解法——NUMINA从attention头反推物体布局再修正,直接插到Wan2.1上无需重训

- 多任务RL的reward分布差异有了系统解法,G²RPO将每个任务的advantage归一化到N(0,1),18个benchmark超越同级开源模型

重点关注

01 机器人 机器人需要专用视觉模块吗?腾讯说不用

Embodied AI领域过去几年流行模块化架构——感知、规划、控制各一个模型,拼成pipeline。腾讯HY-Embodied走了相反的路:用一个VLM(视觉语言模型)统一处理空间感知和任务规划,然后直接接VLA(视觉语言动作模型)做控制。具体释出两个规格:2B激活参数的小模型面向端侧部署,32B激活参数的大模型处理复杂推理,大模型通过on-policy蒸馏把能力灌给小模型。架构上用了MoT(Mixture-of-Transformers),让不同模态走不同的计算路径,缓解视觉和语言互相抢容量的问题。22个benchmark的结果看着不错——2B模型在16个上超过同级SOTA,32B接近Gemini 3.0 Pro——但embodied AI的跑分和真机表现之间的距离是出了名的大,他们给出的真机实验细节还需要看全文确认。对从业者来说,更值得关注的是这个架构选择本身:如果VLM够强,模块化pipeline的复杂度和维护成本可能不再值得承受。

原文:HY-Embodied-0.5: Embodied Foundation Models for Real-World Agents

02 推理加速 扩散语言模型终于敢「全速并行」了?

扩散语言模型(dLLM)的尴尬在于:理论上能并行生成所有token,实际上并行度一拉高就错误累积、质量崩塌。DMax的核心洞察是把解码过程从二值跳变(mask直接变token)改成连续自优化——每一步的解码状态是预测embedding和mask embedding的插值,模型在embedding空间里逐步「提纯」,而不是赌一步到位。配合新的训练策略(On-Policy Uniform Training),模型学会了修正自己的错误预测,这才是激进并行的真正前提。效果很实在:GSM8K上每步有效生成token数从2.04提到5.47,MBPP从2.71到5.86,两块H200单batch跑到每秒1,338个token。

原文:DMax: Aggressive Parallel Decoding for dLLMs

03 Agent 最该学的不是调更多工具,而是克制

Agent调工具太频繁不是bug,是系统性的元认知缺失。现有多模态Agent存在「条件反射式工具调用」——明明从图像就能获取答案,还是会调外部API,导致延迟飙升和噪声累积。现有RL方案用标量惩罚来抑制过度调用,但这产生了两难:惩罚太重压制必要调用,太轻又被精度奖励的方差淹没。HDPO把精度和效率拆成两个正交优化通道——先确保任务做对,再在正确轨迹里优化调用效率,训练出的Metis模型工具调用量降了几个数量级,准确率不降反升。方向扎实,但从摘要看训练依赖合成反事实数据,泛化到开放场景的效果需要看全文确认。

原文:Act Wisely: Cultivating Meta-Cognitive Tool Use in Agentic Multimodal Models

04 视频生成 Attention头里其实藏着可数的物体布局

NUMINA的思路挺巧妙:文生视频模型的self-attention和cross-attention头里,其实已经编码了物体的空间布局信息——只是模型自己用不好。NUMINA在推理阶段挑选出判别力最强的attention头,从中反推出一个可数的latent布局,发现数量不对时就保守地修正这个布局,再通过调制cross-attention引导重新生成。这个方案不改模型、不重训,直接插到Wan2.1系列上,在1.3B模型上计数准确率提升7.4%,5B和14B模型上也有4.9%和5.5%的提升,同时CLIP对齐分数也有改善。不过training-free方案的通病是:简单场景效果明显,复杂场景(物体遮挡、动态交互)的鲁棒性需要更多验证才能下结论。

原文:When Numbers Speak: Aligning Textual Numerals and Visual Instances in Text-to-Video Diffusion Models

05 多模态 当不同视觉任务的reward量级差了一个数量级,混训会怎样?

拿OCR准确率和几何推理准确率直接混在一起做RL训练,reward分布差异会让某些任务主导梯度更新——这是多模态模型用GRPO做强化学习时绑不住的结。OpenVLThinkerV2提出的G²RPO用了一个数学上很直觉的解法:把每个任务的advantage分布强制归一化到标准正态分布N(0,1),让不同任务的梯度贡献在同一量级上。在此基础上加了两个任务级调控:对复杂推理任务鼓励长链思考,对视觉定位任务强制短输出;同时用熵约束防止探索过度发散或坍缩。18个benchmark的评测显示效果优于同级开源模型和部分商用模型,但摘要没给具体数字对比,需要看全文确认提升幅度。

原文:OpenVLThinkerV2: A Generalist Multimodal Reasoning Model for Multi-domain Visual Tasks

也值得关注

今日观察

今天10篇highlight里5篇是agent论文,但拆开看会发现一个有意思的分布:没有一篇在构建新的agent能力。

ClawBench拿153个日常任务和144个真实网站测了一圈,结论是最强模型的成功率也不到一半。KnowU-Bench测的不是agent能不能做,而是能不能判断什么时候不该做。Act Wisely直接对准了「条件反射式工具调用」——HDPO训练后工具调用量降了几个数量级,准确率反而上升。MolmoWeb释出完全开源的web agent baseline,Structured Distillation用3000条轨迹把Gemini 3 Pro的能力蒸馏进9B模型,六个web环境上接近甚至超过teacher。

五篇分别在做的事情是:测量边界、定义克制、降低成本。没有人在扩展能力。

同一天,非agent领域画风不同。DMax把扩散LM的并行效率提了近3倍,NUMINA在不改模型的前提下修正了视频计数,OpenVLThinkerV2解决了多任务RL中reward分布不可比的老问题。这些论文仍在正面推高性能上限。

对搭agent的团队,一个具体建议:在投入下一个工具集成之前,先拿ClawBench或类似框架跑一遍现有系统,量化「哪些任务根本不需要调工具」。Act Wisely的数据表明,砍掉冗余调用带来的收益可能比加新工具更直接。