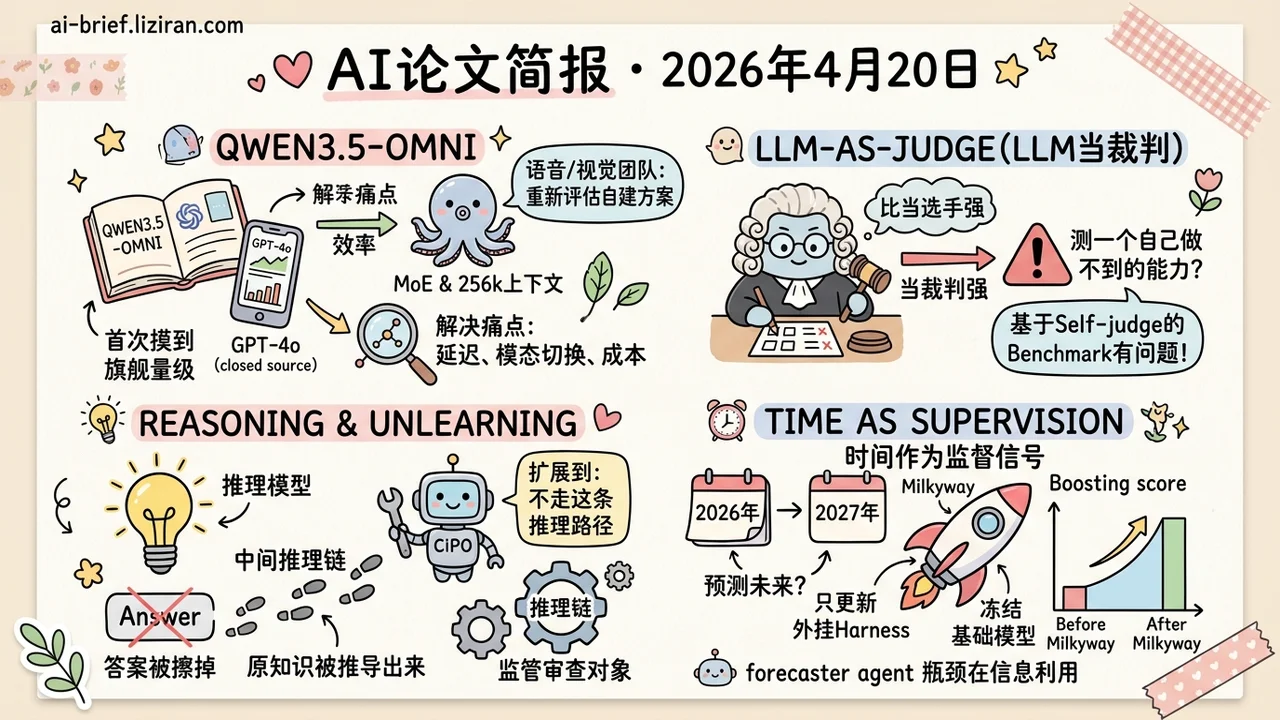

今日概览

- 开源omni首次摸到闭源旗舰量级:Qwen3.5-Omni扩到几百亿参数+256k上下文+MoE,工程上对准了上一代的延迟、模态切换和长上下文成本痛点,语音/视觉团队到了重新评估自建方案的时点。

- LLM当裁判比当选手强,这事对评测基础设施是个红旗——基于self-judge的benchmark和reward signal可能在测一个模型自己都做不到的「能力」。

- 推理模型让unlearning重新定义:就算最终答案被擦掉,中间推理链会把原知识一步步推回来,CiPO把「不输出」扩展到「不走这条推理路径」。

- 公开信息的时间演化本身就是监督信号,Milkyway冻结基础模型只更新外挂harness就能把forecasting分数大幅拉高。

重点关注

01 多模态 开源omni第一次推到几百亿参数,语音/视觉团队该不该重估自建方案

对在做语音、视觉应用的团队来说,Qwen3.5-Omni把开源omni模型拉到几百亿参数+256k上下文的规模,架构上用Hybrid Attention MoE分别给Thinker和Talker提效,这是开源侧第一次在体量上直接对标闭源旗舰。上一代Omni被抱怨最多的是推理延迟、模态切换和长上下文成本,这次的工程重点看得出来都对着这几个痛点——MoE压长序列推理开销,新引入的ARIA模块动态对齐文本和语音token,据称解决了流式TTS里编码效率不匹配导致的不稳定和韵律问题。报告宣称在215个音频和音视频子任务上SOTA、关键音频任务超过Gemini-3.1 Pro、综合音视频理解与之持平,但技术报告通常乐观,这些数字得用自己的线上case复测才算数,尤其是延迟和稳定性这种benchmark不会暴露的东西。比较值得留意的是一个涌现能力:根据音视频指令直接写代码(团队叫Audio-Visual Vibe Coding),以及10小时音频理解、400秒720P视频(1FPS)这种超长上下文场景,如果这些真的稳定,能打开一些原本只能靠多模型拼接做的产品形态。对评估「是否能把闭源API变成可选项」的团队,现在该做的不是对着分数表看,而是用自己最头疼的case压一遍——TTS流式稳定性、多模态切换延迟、长音视频理解的实际吞吐和成本。

原文:Qwen3.5-Omni Technical Report

02 评测 模型当裁判比当选手强,这事比想象中麻烦

过去两年,LLM-as-judge几乎是评测和RLAIF的默认基础设施——让强模型给弱模型打分、做PRM、筛数据。这篇ACL论文在三个语用任务上直接对比了同一批模型「作为听众判断语言是否得体」和「作为说话者生成得体语言」的表现,发现大多数模型当裁判明显强于当选手。表面看是好消息(至少裁判能用),但反过来想:模型判断得出来却生成不出来的那个「能力」,究竟存不存在?如果判断和生成只是弱相关,那基于模型自评的benchmark和reward signal可能在测一个幻影。当然这只是语用维度的结论,数学、代码这些有明确答案的任务不一定有同样的不对称——但对任何用judge筛训练数据或做偏好学习的团队,这是个需要自查的红旗。

03 安全对齐 推理模型让「遗忘」这件事变难了

过去做unlearning,目标是让模型不再吐出某条隐私或版权信息——遮住嘴就行。但LRM(大推理模型)引入长链思考后出现一个尴尬局面:就算最终答案被擦掉,中间推理链会一步步把原知识重新推导出来。CiPO的切入点是把「不输出」扩展到「不走这条推理路径」——让模型生成一条逻辑自洽的反事实推理轨迹,再用迭代偏好优化把原始轨迹推开。论文声称能在保留推理能力的同时彻底清除中间步骤里的知识,但这类方法一贯的风险是在越狱或诱导性prompt下可能复原,需要看全文的对抗测试才能下结论。更值得记住的是问题本身:reasoning模型时代,unlearning、安全对齐、版权合规都要重新定义——监管的审查对象不再只是输出,而是整条推理链。

原文:CiPO: Counterfactual Unlearning for Large Reasoning Models through Iterative Preference Optimization

04 Agent 同一个事件被反复改写的措辞,已经泄漏了结局

公开信息在时间维度上是会泄漏未来的——同一个未决事件在不同时刻被报道、引用、修订的措辞差异,本身就携带关于真实结局的统计信号。Milkyway把这个观察变成了一套机制:同一个问题被反复预测时,前后两次预测的时间对比能暴露早期哪些因素没追踪到、哪些证据漏了、哪些不确定性被低估——这是一种不用等事件resolve就能拿到的「内部反馈」。更意外的是,基础模型完全冻结,只更新一个外挂的预测harness(负责因素追踪、证据搜集、不确定性处理),在FutureX把分数从44提到61,在FutureWorld从62提到78。这把forecasting agent的瓶颈从「推理能力」重新定位到了「对信息演化的精细利用」。

原文:The World Leaks the Future: Harness Evolution for Future Prediction Agents