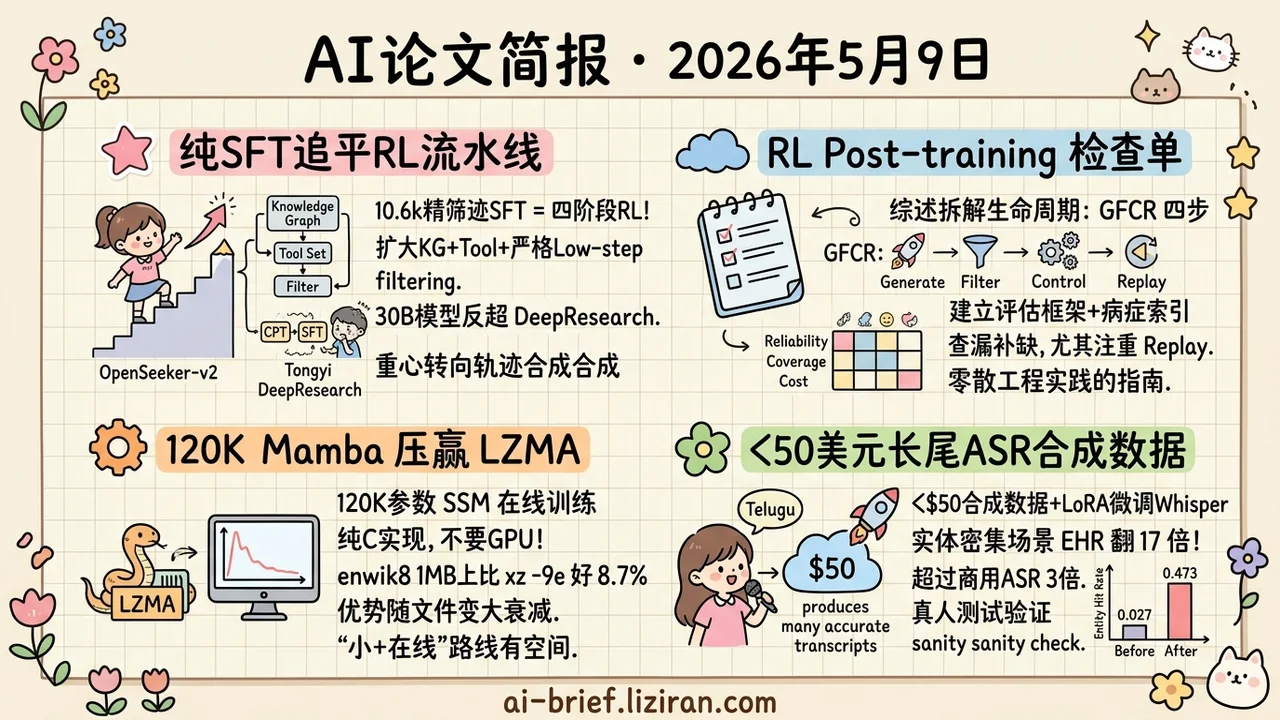

今日概览

- 10.6k条精筛轨迹纯SFT就追平四阶段RL流水线:OpenSeeker-v2扩大knowledge graph和tool set、配上严格的low-step filtering,30B模型在BrowseComp/HLE/xbench上反超走完CPT+SFT+RL的Tongyi DeepResearch——值得砸资源的环节正在从优化器下移到轨迹合成。

- RL post-training的rollout第一次有了可对照的checklist:新综述把生命周期拆成Generate/Filter/Control/Replay四步,配可靠性/覆盖率/成本敏感度的三维评估和病症映射索引。

- 120K参数Mamba在普通CPU上压赢LZMA:StateSMix在线训练+sparse n-gram+算术编码,纯C实现不要GPU,enwik8 1MB上比xz -9e好8.7%,但优势随文件变大快速衰减到0.7%。

- <50美元合成数据让开源ASR在长尾语言上做到商用3倍:Indic TTS合成约22000条实体密集语音+LoRA微调Whisper-Telugu,Entity-Hit-Rate从0.027拉到0.473,20条真人录音sanity check缓解了同TTS自循环担忧。

重点关注

01 Agent 10.6k条精筛轨迹做SFT,打平了完整四阶段流水线

用10.6k条数据做纯SFT就训出了frontier search agent,OpenSeeker-v2的差异不在算法,在数据筛选这一步。他们做了三个不复杂的修改:扩大knowledge graph规模带来更广的探索空间、扩大tool set覆盖更多功能、用严格的low-step filtering筛掉太容易的样本。最后训出来的30B模型在BrowseComp、BrowseComp-ZH、HLE、xbench四个benchmark上都超过了走完整CPT+SFT+RL流水线的Tongyi DeepResearch。对从业者的启示是把「值得砸资源的环节」重新定位——同等预算下,把钱花在合成更难、更informative的轨迹上,可能比再叠一段RL更划算。一个要保留的范围限制:他们对比的都是deep search这种相对结构化的agent任务,更长horizon或更开放式的agent场景能不能复用这个结论,论文里没有验证。

原文:OpenSeeker-v2: Pushing the Limits of Search Agents with Informative and High-Difficulty Trajectories

02 训练优化 你的RL流程里,rollout这四步少做了哪一环?

做RL post-training的团队多半都在重造rollout的轮子,但很少有人把这部分实践写清楚——优化器的论文一大堆,rollout怎么设计基本靠口耳相传。这篇综述把整个生命周期拆成四步:Generate(生成候选轨迹和拓扑)、Filter(用verifier或judge筛中间信号)、Control(在预算内分配算力、决定继续/分支/停止)、Replay(保留和复用 artifact,包括自演化课程)。配套还有一个可靠性、覆盖率、成本敏感度的三维评估框架,以及把常见 rollout 病症映射到具体模块的诊断索引。它的价值不在于提出新方法,而在于第一次给这套零散工程实践提供了一张可对照的表。

03 模型架构 120K参数的Mamba在你的CPU上跑赢了LZMA

直觉上,能打过工业级压缩算法的应该是某个大模型加GPU的方案。但StateSMix反着来:一个只有120K参数的Mamba SSM,从零开始在被压缩的文件本身上token-by-token在线训练,配9张sparse n-gram哈希表和算术编码,纯C实现、AVX2 SIMD、不要GPU也不要预训练权重,在普通x86-64上每秒处理约2000个token。enwik8上1MB比xz -9e好8.7%,3MB好5.4%,10MB只好0.7%——优势随文件变大快速衰减,但小文件场景的差距是真实的,消融里SSM单独就能打过xz,n-gram再加4.1%。LLM主导叙事的两年里,「小模型+在线学习+经典编码」这条路看起来已经被默认抛弃,但边缘设备、隐私敏感数据、长尾文件类型这些场景,120K参数的自适应模型其实是合适的尺寸。

原文:StateSMix: Online Lossless Compression via Mamba State Space Models and Sparse N-gram Context Mixing

04 多模态 <50美元合成数据,把开源ASR在长尾语言上拉到商用3倍

开源Whisper-Telugu在数字串、地址、品牌名、英语-Indic codemix上的Entity-Hit-Rate只有0.027,商用Deepgram Nova-3是0.16——长尾语言加实体密集场景,两边都不及格。作者搭了条TTS↔STT飞轮:开源Indic TTS合成约22000条实体密集语音(边际成本不到50美元),LoRA微调Whisper-Telugu后EHR拉到0.473(开源的17倍、商用的3倍),FLEURS-Te朗读体WER只多6.6个点。一个明显的自循环风险是held-out来自同一TTS系统,但作者补了20条真人Telugu录音做sanity check,EHR 0.516比合成测试还高,暂时缓解了「只在自己合成数据上有效」的担忧。Hindi和Tamil上也有显著提升,但Hindi上商用仍领先,三种语言全部低于作者预注册的EHR目标,照实报告。

也值得关注

今日观察

把今天三篇放在一起,能看到一个一致的位移:决定agent能力的位置正在从「算法/loss」下移到「轨迹/环境/数据」。OpenSeeker-v2的论点是高质量轨迹+简单SFT能逼近重型RL流水线;Rollout综述把RL的核心拆成generate/filter/control/replay四个rollout环节,而不是优化器细节;再加上notable里的Healthcare AI GYM,把训medical agent的重心放在10个临床领域的gym环境,而不是新算法。三篇切入点不同,但共同把「值得投资源的位置」指向同一处:trajectories和environment决定上限,算法只是落实工具。

需要避免的过度延伸:这不是「RL已死、SFT复兴」——三篇里两篇仍在RL框架里讲事,OpenSeeker-v2自己也只在结构化的deep search任务上做了对比,更长horizon场景没有验证。

具体行动建议:如果在做agent post-training,下一轮迭代不要先去换RL算法,先核对trajectory pipeline的杠杆是不是已经吃满——生成端knowledge graph和tool set的覆盖、筛选端的难度分布和low-step过滤、复用端的replay策略,这三处任意一个缺口可能比换optimizer更值得修。