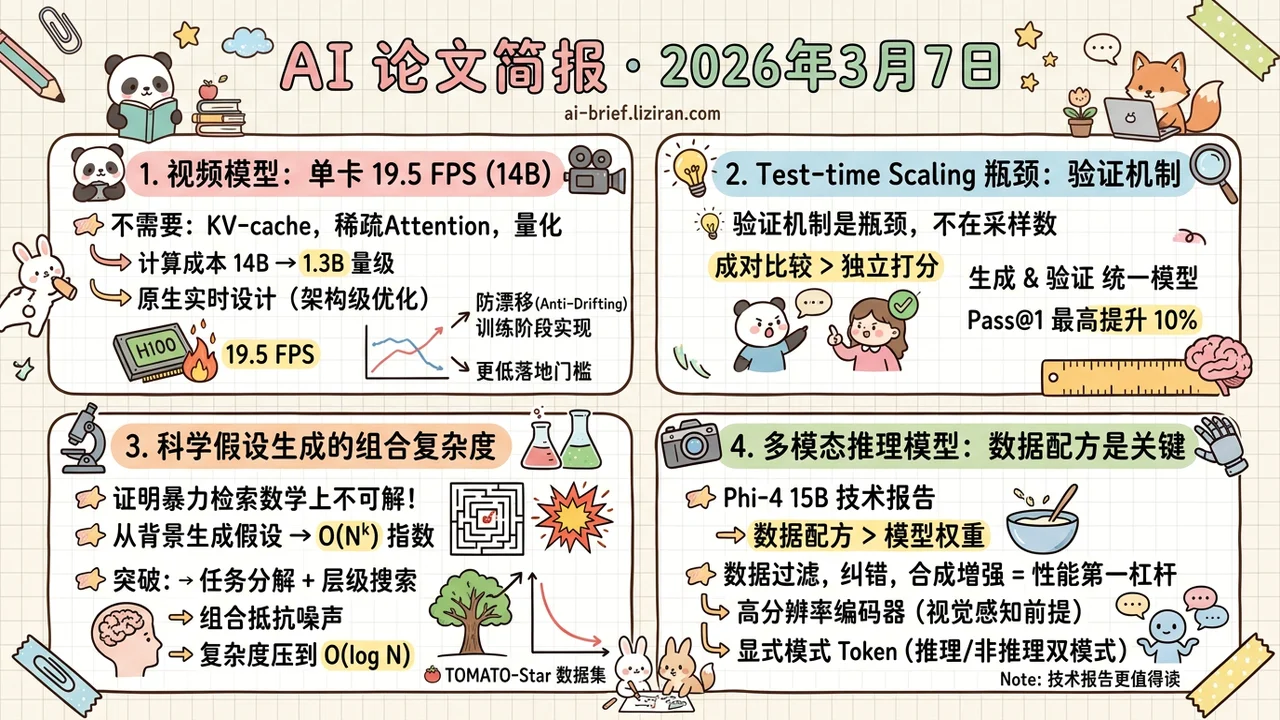

今日概览

- 14B视频模型单卡19.5 FPS,不用KV-cache、稀疏attention或量化推理,架构原生为实时设计而非事后加速补丁。

- 验证机制才是test-time scaling的真正瓶颈——V1发现成对比较远优于独立打分,将生成和验证统一进同一个模型,Pass@1最高提升10%。

- 科学假设生成的组合复杂度从O(N^k)压到O(log N),MOOSE-Star先证明暴力检索在数学上不可解,再用任务分解+层级搜索绕过壁垒。

- 多模态推理模型的性能第一杠杆是数据配方:Phi-4-reasoning-vision-15B技术报告的消融实验和设计取舍记录,比模型权重本身更值得读。

重点关注

01 视频生成 不用KV-cache不用量化,14B视频模型单卡跑到实时

14B参数的视频模型,单张H100上19.5 FPS,支持分钟级连续生成——数字本身就够硬,但更值得关注的是实现路径。Helios没用KV-cache,没用稀疏attention或线性attention,没用量化推理,也没用任何常见的anti-drifting技巧——self-forcing、error bank、关键帧采样统统没有。这不是在现有架构上贴加速补丁,而是从头为实时生成设计的自回归扩散架构。核心思路是极致压缩历史帧和噪声上下文的表示,同时减少采样步数,把14B模型的计算成本压到跟1.3B模型一个量级。长视频的drift(画面漂移)问题也没靠推理时的heuristic去堵,而是在训练阶段显式模拟漂移并消除重复运动的根源。团队还做了基础设施级的优化,训练时80GB显存能装下4个14B模型,不需要并行或分片框架。社区127个upvote反映的不只是对效果的认可,更是对部署可行性的兴奋——当一个模型不依赖任何特殊加速基础设施就能实时跑,落地门槛会低一个数量级。

原文:Helios: Real Real-Time Long Video Generation Model

02 推理 并行推理的瓶颈不是生成更多答案,而是找到对的那个

Test-time scaling(推理时扩展计算)的常见做法是并行采样多个候选解再挑最好的,但瓶颈往往不在采样本身。Berkeley的V1发现了一个有意思的不对称:模型独立给单个解打分的准确率远低于两两比较。基于这一点,V1把生成和验证统一进同一个模型——用锦标赛式的成对排序替代逐个打分,并通过不确定性引导把验证算力集中在最难区分的候选对上。代码生成和数学推理任务上,成对验证比独立打分的Pass@1最高提升10%,同时比其他test-time scaling方法更省计算。

原文:$V_1$: Unifying Generation and Self-Verification for Parallel Reasoners

03 AI for Science 先证明「此路不通」,然后把它走通了

用LLM做科学发现,多数工作在琢磨怎么写prompt或怎么用反馈微调。MOOSE-Star问了个更底层的问题:能不能直接训练模型学会「从背景知识生成假设」?他们先给出了一个令人沮丧的证明——从海量知识库中检索和组合灵感的复杂度是O(N^k),数学上不可解。然后反手把问题拆开:将发现过程分解为子任务,用动机引导的层级搜索实现对数级检索,再通过有界组合抵抗噪声,最好情况下复杂度从指数降到O(log N)。配套释出的TOMATO-Star数据集(10.8万篇拆解论文,耗费3.8万GPU小时)让这套方案可以实际训练,而且暴力采样撞上「复杂度墙」的地方,MOOSE-Star仍展现出持续的test-time scaling能力。

原文:MOOSE-Star: Unlocking Tractable Training for Scientific Discovery by Breaking the Complexity Barrier

04 多模态 训多模态推理小模型,数据配方比架构更关键

训一个紧凑型多模态推理模型,最大的未知不是架构选什么,而是数据怎么配。Phi-4-reasoning-vision-15B的技术报告详细记录了这个过程:系统化的数据过滤、纠错和合成增强带来的提升远超架构创新。在架构层面,高分辨率动态分辨率编码器带来了稳定收益——准确的视觉感知是高质量推理的前提。一个实用的设计是用显式模式token区分推理和非推理数据,让单一模型既能快速回答简单问题,也能对复杂问题做链式思考。对正在探索这个方向的团队,报告中的系统消融实验——哪些策略有效、哪些被放弃——可能比15B的模型权重本身更有参考价值。

也值得关注

今日观察

V1采样100个候选解,发现选不出最好的那个。MOOSE-Star从知识库检索灵感,发现组合空间是指数爆炸的。Memex(RL)让agent跑长程任务,发现关键信息被淹没在历史里。三个系统各自解决了具体问题,但它们成立的前提相同:生成环节已经足够强,卡点转移到了「从生成结果中定位正确答案」。

这个转移的含义很实际。过去两年,行业把大量资源投入更大的模型和更多的采样,换来的生成能力已经溢出——但验证、检索和知识组合的基础设施还停留在上一代。V1证明成对验证比独立打分好10%,MOOSE-Star把检索复杂度从指数级压到对数级,Memex(RL)用索引化记忆让远端证据可达。这些都不是在做更好的生成,而是在做更好的筛选。

如果你在规划产品或基础设施,做一件事:审计你系统里生成和筛选的算力比。当生成侧已经能产出足够多的候选方案时,把更多预算投向验证和检索机制,回报可能更高。