今日概览

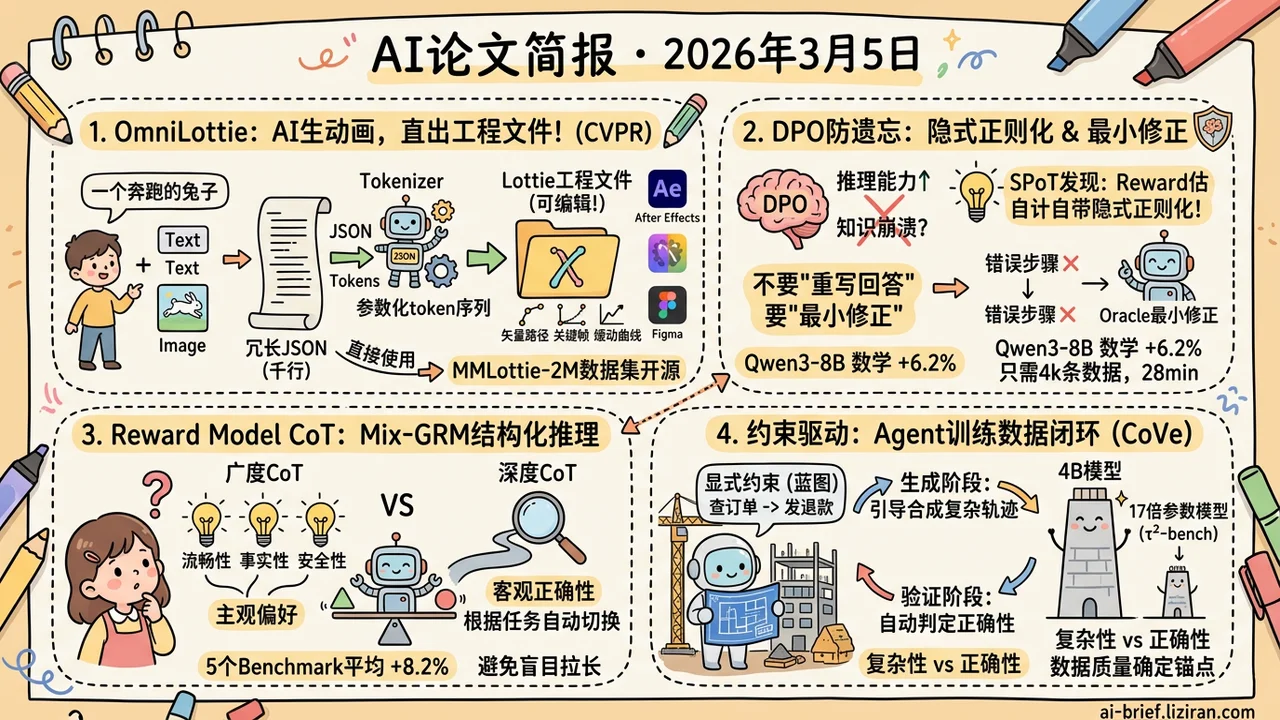

- AI生成动画首次直接输出可编辑工程文件,OmniLottie把Lottie的冗长JSON压缩成参数化token序列,让视觉语言模型直接生成带关键帧和缓动曲线的矢量动画,省去格式转换环节。CVPR接收,200万动画数据集已开源

- DPO的reward估计自带隐式正则化,本身就能抑制灾难性遗忘。SPoT发现很多常见post-training做法反而在破坏这个内置保护,用4k条最小修正数据即可让Qwen3-8B数学任务提升6.2%

- Reward model的CoT不是越长越好:Mix-GRM区分了广度CoT和深度CoT,两者服务不同任务类型。结构化拆分后在5个benchmark上平均超现有最优开源模型8.2%

- 约束同时充当生成蓝图和质检标准。CoVe用显式约束驱动agent训练数据的合成与验证闭环,4B模型在τ²-bench上与17倍参数量模型竞争

重点关注

01 视频生成 AI生成动画第一次直接输出生产格式

Lottie是前端矢量动画的事实标准——轻量、跨平台、带关键帧和缓动曲线,但它的JSON文件动辄几千行,充斥着结构性元数据和格式化token。OmniLottie的核心思路是设计了一套Lottie tokenizer,把冗长的JSON压缩成「命令+参数」的结构化序列,只保留形状、动画函数和控制参数,砍掉所有不变的格式噪音。这让预训练的视觉语言模型可以直接学习生成Lottie动画,输入可以是文本、图片或混合指令。关键区别在于输出物:不是像素视频或GIF,而是完整的Lottie工程文件——带矢量路径、关键帧、缓动曲线,设计师拿到就能在After Effects或Figma里继续编辑。团队还构建了MMLottie-2M数据集,包含200万个专业设计的矢量动画及其文本和视觉标注,这个数据规模本身就是一个贡献。CVPR接收,HF社区121个upvote,代码已开源。

原文:OmniLottie: Generating Vector Animations via Parameterized Lottie Tokens

02 训练优化 DPO自带「防遗忘」,你可能一直在重复造轮子

做DPO post-training的团队大概都经历过这个焦虑:模型推理能力上去了,但之前学的知识开始崩。标准操作是加on-policy数据、搞replay buffer,各种防遗忘机制叠上去。但SPoT这篇的发现让人意外——DPO的reward估计本身就藏着一个隐式正则化机制,理论上就能抑制灾难性遗忘,只是之前没人认真挖过。更违反直觉的是,很多常见的post-training做法反而在破坏这个内置保护。他们据此设计了一套「手术式」训练方案:用Oracle对错误推理步骤做最小修正(而不是重写整个回答),配合二元交叉熵目标函数替代DPO的相对排序。结果是只用4k条修正数据、28分钟训练,Qwen3-8B在数学任务上平均提升6.2%,域内域外都涨。

原文:Surgical Post-Training: Cutting Errors, Keeping Knowledge

03 评测 Reward Model的推理链越长越好?未必,关键看怎么「长」

用CoT(思维链)让reward model多想一会儿再打分,效果确实更好——这已经是共识。但Mix-GRM揭示了一个被忽略的区分:广度CoT(覆盖多个评判维度,比如流畅性、事实性、安全性)和深度CoT(在单个维度上做深入推敲)的效果完全不同。盲目延长推理链,不区分广度和深度,评估质量反而会打折扣。具体来说,广度CoT在主观偏好任务(如风格判断)上更有效,深度CoT在客观正确性任务上更强——用错了方向,性能直接下降。Mix-GRM通过结构化拆分这两种推理模式,再用RLVR(可验证奖励的强化学习)训练,让模型自发学会根据任务类型切换推理策略,在5个benchmark上平均超过现有最优开源reward model 8.2%。

原文:Beyond Length Scaling: Synergizing Breadth and Depth for Generative Reward Models

04 Agent 用约束做质检:当数据合成和验证共用同一套规则

训练tool-use agent的数据很难做——用户意图模糊,但工具调用容错率极低,合成数据要么太简单不够用,要么复杂了质量没法保证。CoVe的思路是先把任务拆成显式约束(比如「必须查询订单状态后才能发起退款」),然后让这些约束同时扮演两个角色:生成阶段用来引导合成复杂多轮轨迹,验证阶段用来自动判定轨迹是否正确。这样SFT和RL的训练信号都能从同一套约束中推导出来,数据质量有了确定性的锚点。

原文:CoVe: Training Interactive Tool-Use Agents via Constraint-Guided Verification

也值得关注

今日观察

今天三条线索交汇在「结构化评估」上。Mix-GRM发现reward model的CoT推理需要区分广度和深度两种机制,盲目拉长推理链反而有害;RubricBench揭示rubric-guided评估本身缺乏衡量标准——我们在用没有经过校准的尺子量东西;CoVe则展示了另一种路径,用显式约束同时指导数据生成和质量验证,让评估标准从主观判断变成可执行的规则。

这三个工作共同指向一个趋势:随着模型能力提升,「让评估者多想一会儿」已经不够了,评估过程本身需要被工程化——拆分维度、定义标准、设计约束。两年前LLM评估从单一分数走向多维rubric,现在这个需求传导到了reward model和agent训练的数据质量环节。评估不再是训练完之后的「验收」步骤,而是贯穿整个pipeline的基础设施。

如果你的团队在做RLHF或agent训练,值得审视一个问题:你的reward signal经过了多少层结构化设计?如果答案是「直接用模型打分」或「一条CoT走到底」,今天这三篇论文各自提供了一个可以立即尝试的改进方向。