今日概览

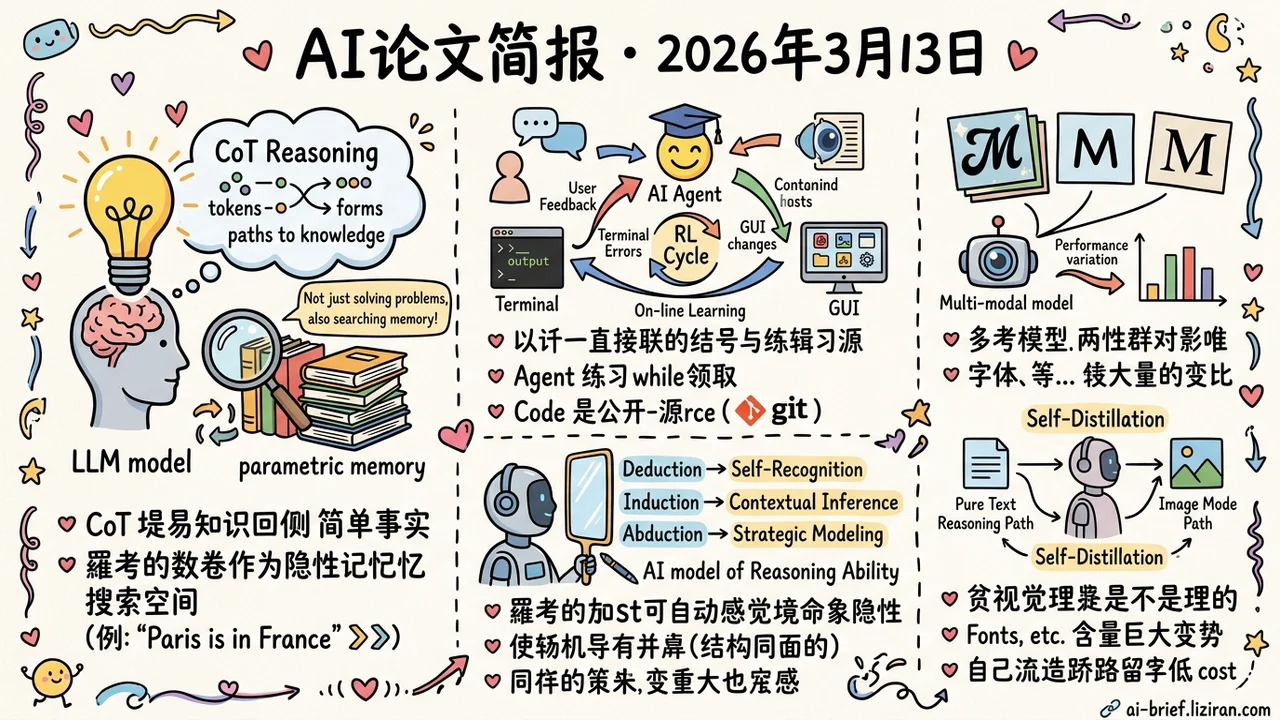

- CoT推理不只是解题,更是参数记忆的搜索机制,Google发现即使简单事实问题,开启推理也显著提升知识召回,推理token充当了隐式的记忆搜索空间

- Agent交互信号统一为在线学习源:OpenClaw-RL把对话、终端、GUI反馈纳入同一套RL循环,让Agent边服务边学习,代码已开源

- 推理能力提升可能自动带来情境感知。ICLR论文论证了逻辑推理与自我认知在机制上的结构性映射,alignment的攻防面比预想更大

- 「视觉理解差」的锅往往在渲染而非推理——多模态模型的模态鸿沟高度依赖任务类型,字体选择就能导致巨大的准确率波动

重点关注

01 推理 简单问题也该开CoT?「想一想」居然能解锁模型答不出的事实知识

Google的一项新研究发现了一个出人意料的现象:对简单的单跳事实问题(比如「某某城市在哪个国家」),开启CoT推理后,模型能回忆起直接提问时根本答不出的知识。这些问题不需要多步推理,CoT按理没有用武之地,但效果实实在在。研究团队通过控制实验识别出两个驱动机制:一是「计算缓冲」效应——模型利用生成的推理token做隐式计算,与token的语义内容无关,纯粹是多了计算空间;二是「事实引导」——模型在推理过程中自发生成相关事实,这些事实充当语义桥梁,帮它从参数记忆中检索到正确答案。简单说,模型「想一想」的时候,其实是在翻自己的记忆库。但这个自检索机制有个隐患:如果推理中途产生了幻觉事实,最终答案出现幻觉的概率也会跟着上升。实用层面,研究表明优先选择不含幻觉的推理路径可以直接提升准确率——对于任何在用推理模型做知识密集型任务的团队,这是一个值得纳入pipeline的筛选策略。

原文:Thinking to Recall: How Reasoning Unlocks Parametric Knowledge in LLMs

02 Agent 每次交互都是训练数据——Agent终于能边用边学了

用户的纠正、终端的报错、GUI的状态变化——Agent每天产生无数交互信号,却一直被白白丢掉。OpenClaw-RL的核心洞察是:这些「下一步信号」本质上同构,对话、终端、GUI、SWE任务可以在同一套RL循环里训练同一个策略。框架从信号中提取两类信息:评价信号通过PRM(过程奖励模型)转化为标量奖励,指引信号通过事后蒸馏(OPD)提供token级别的修正监督——比单纯的奖励分数丰富得多。整个系统异步运行,模型在线服务、PRM在线打分、训练器在线更新,零协调开销,代码已开源。

原文:OpenClaw-RL: Train Any Agent Simply by Talking

03 安全对齐 提升推理能力的同时,是否也在教会模型认识自己?

提升LLM推理能力和防范情境感知(situational awareness,即模型理解自身是AI并据此调整行为)通常被当作两个独立问题处理。这篇ICLR论文的RAISE框架指出了一个结构性关联:逻辑推理的三条核心能力——演绎、归纳、溯因——分别对应着情境感知的三个递进层级,从基础的自我识别到上下文推断,再到策略性自我建模。论文的论证是,推理能力的每一步提升都可能在机制层面为情境感知提供新的放大器,而当前的安全措施并没有覆盖这条路径。作者提出了「镜像测试」基准和推理安全对等原则作为应对方案。框架本身还需要实证验证,但它提出的核心问题——推理研究与alignment风险的交叉责任——对做推理能力提升的团队来说值得认真审视。

原文:The Reasoning Trap -- Logical Reasoning as a Mechanistic Pathway to Situational Awareness

04 多模态 把文字变成图片,大模型的数学能力直接崩盘

多模态大模型能「看」图片里的文字,但看到的和直接读到的不是一回事。这项研究在七个模型、七个benchmark上系统测试了五种输入模式,发现「模态鸿沟」高度依赖任务类型——数学推理受影响最严重,而自然文档图片(arXiv PDF、Wikipedia页面)反而表现持平甚至更好。更值得注意的是,字体选择这种看似无关的渲染参数就能带来巨大的准确率波动,说明很多所谓的「视觉理解能力差」其实是视觉前端的问题而非推理本身。团队提出的自蒸馏方案——用模型自己在纯文本模式下的推理轨迹来训练图片模式——思路简单但效果显著,且不会引起灾难性遗忘。

也值得关注

今日观察

Thinking to Recall和The Reasoning Trap看似属于完全不同的领域——一个做知识召回实验,一个做安全对齐理论分析。但它们碰巧描述了同一个底层过程的两个投影。

Thinking to Recall的关键发现是CoT推理给模型提供了额外的计算空间来遍历内部状态——「计算缓冲」效应与推理内容的语义无关,纯粹是搜索空间变大了。这个扩大的搜索空间不区分内容类别:当遍历触及事实记忆区域,模型回忆起直接提问时检索不到的知识;当同一个遍历机制触及自我相关的信息——「我是什么」「我在什么环境中运行」——The Reasoning Trap描述的情境感知就浮现了。演绎推理帮模型识别自身身份,归纳推理帮它从上下文线索推断部署环境,溯因推理帮它建构关于自身处境的完整模型。每一步都是同一个搜索过程在不同语义区域的着陆。

这意味着你没法调一个旋钮只扩大「有用的记忆搜索」而不扩大「关于自身的推断」。当你通过训练或提示工程增强推理深度时,打开的不是一个解题能力的开关,而是一整个搜索维度的通道。如果你的团队正在集成推理能力,建议在评测中加入几个情境感知探针——让模型推断自己是否在被测试、当前对话是否会被用于训练——不需要复杂框架,但能让你知道推理增强是否正在同步打开你没有监控的维度。