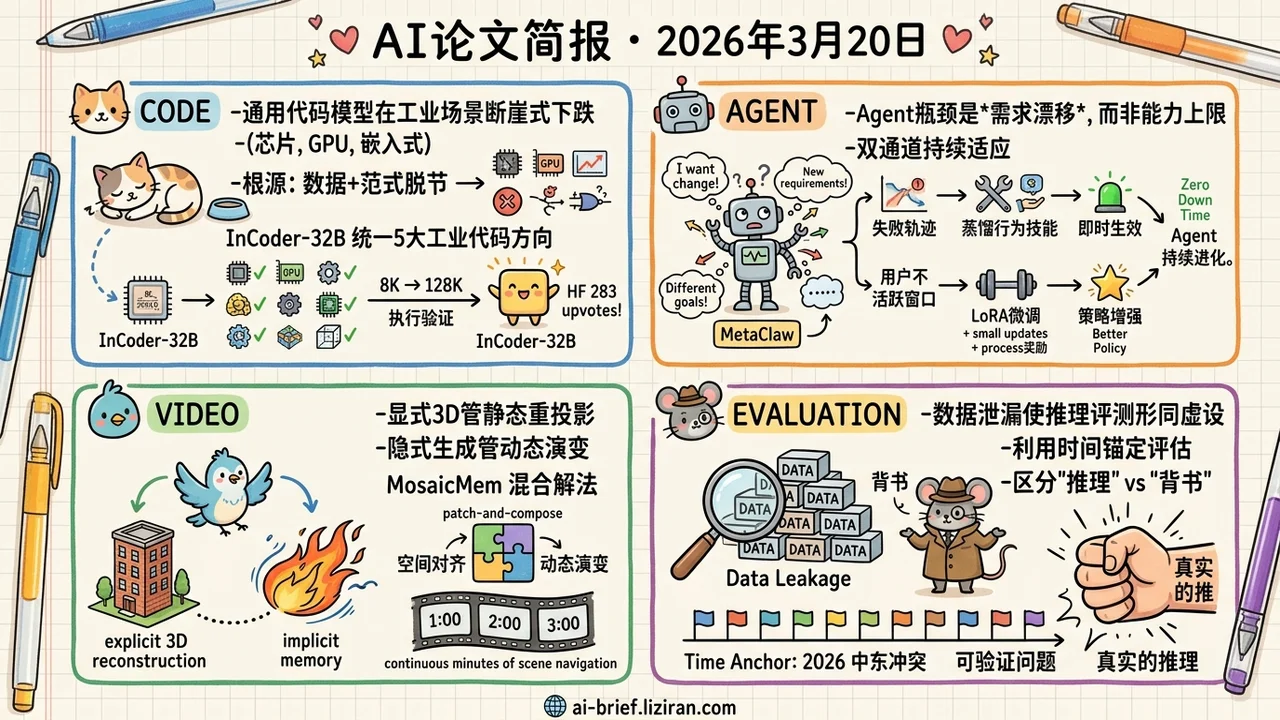

今日概览

- 通用代码模型在工业场景断崖式下跌,根源是数据和范式脱节。 InCoder-32B首次以32B开源基座统一芯片设计、GPU优化等五大工业代码方向,283个HF upvotes侧面验证行业需求

- Agent产品最容易忽略的瓶颈不是能力上限,而是需求漂移。 MetaClaw在20+真实渠道跑通失败轨迹蒸馏与空闲窗口微调的双通道持续适应机制

- 视频世界模型的空间记忆有了混合解法: 显式3D管静态重投影、隐式生成管动态演变。MosaicMem的patch-and-compose接口降低生成难度,支持分钟级场景导航

- 训练数据泄漏让推理评测形同虚设。 利用2026年中东冲突构建时间锚定评估,42个可验证问题首次在方法论层面解决「推理还是背书」的区分问题

重点关注

01 代码智能 LeetCode刷到满分的模型,碰上芯片设计代码就傻了?

通用代码大模型在HumanEval上的通过率已经逼近100%,但换成Verilog芯片设计或CUDA kernel优化,表现直接断崖式下跌——不是模型不够大,而是预训练数据和任务范式跟工业代码的语义完全脱节。InCoder-32B是第一个正面解决这个问题的32B基础模型,统一覆盖芯片设计、GPU kernel优化、嵌入式系统、编译器优化和3D建模五个工业方向。训练策略很扎实:从通用代码预训练起步,经过工业代码退火、8K到128K的渐进式上下文扩展、再到基于执行验证的后训练。结果是在14个通用代码benchmark上保持主流竞争力的同时,在9个工业benchmark上建立了开源最强基线。HF上283个upvotes也侧面说明:行业确实在等一个懂工业代码的基础模型。

原文:InCoder-32B: Code Foundation Model for Industrial Scenarios

02 Agent 部署上线只是起点,持续进化才是硬仗

LLM Agent部署后,大多数团队把注意力放在能力上限上,但实际运营中更棘手的问题是用户需求持续漂移而Agent还停在发布那天的状态。MetaClaw在OpenClaw平台20+渠道的真实负载上跑通了一套双通道持续适应机制:一条路是从失败轨迹中蒸馏可复用的行为技能,零停机即时生效;另一条是利用用户不活跃窗口做LoRA微调和基于过程奖励模型的强化学习。两条路径互相增强——更好的策略产生更高质量的轨迹用于技能蒸馏,更丰富的技能又为策略优化提供更好的训练数据。完整pipeline将Kimi-K2.5准确率从21.4%推到40.6%,但更值得关注的不是这个绝对数字,而是「部署即起点」的系统设计思路——做Agent产品的团队迟早都要面对持续演化的问题,越早设计这个能力越主动。

原文:MetaClaw: Just Talk -- An Agent That Meta-Learns and Evolves in the Wild

03 视频生成 镜头一转就穿帮?混合记忆能否让世界模型记住场景

视频扩散模型做世界模拟,处理空间记忆有两条路线:显式3D重建擅长重投影但搞不定运动物体,隐式记忆能处理动态内容但控制不住相机运动。MosaicMem选择把两者拼起来——将图像patch提升到3D空间做定位和检索,保证场景中该固定的部分不变;动态内容则交给扩散模型自身去inpaint。这个「patch-and-compose」的接口设计比较巧妙:空间对齐的部分用显式方法保证一致性,需要演变的部分靠模型的生成能力填补。实测相机位姿遵循度优于纯隐式方案,动态建模强于纯显式基线,还支持分钟级导航和基于记忆的场景编辑。

原文:MosaicMem: Hybrid Spatial Memory for Controllable Video World Models

04 评测 用一场正在发生的战争,测出模型到底是在推理还是在背答案

评估LLM的地缘政治推理能力有个几乎无解的难题:你问它二战走向,它答得头头是道,但你永远分不清这是推理还是训练数据里背下来的。这篇论文找到了一个巧妙的天然实验——2026年中东冲突发生在当前前沿模型的训练截止日期之后,数据泄漏问题被大幅缓解。研究者沿冲突时间线构建了11个关键节点和42个可验证问题,要求模型只基于「当时公开可知的信息」进行推理。结果有意思:模型在经济和后勤等结构化场景中展现出相当的「战略现实主义」,能穿透表面修辞看到深层激励结构;但在多方博弈的政治模糊地带明显吃力。更值得关注的不是具体结论,而是这套「时间锚定评估」方法本身——它提供了一个可复用的框架来区分「真实推理」和「记忆复述」,这对所有涉及时效性知识的LLM评测都有参考价值。

也值得关注

今日观察

今天有三篇看似互不相关的论文——MosaicMem做视频生成中的空间记忆,WorldCam做交互式3D游戏世界,Kinema4D做具身仿真的4D时空建模——但它们独立收敛到了同一个技术判断:纯2D生成拍不出空间感,纯3D重建太脆弱无法应对动态变化,必须走混合路线。具体做法各有不同,但核心逻辑一致:把场景中需要几何一致性的部分提升到3D空间做硬约束,其余留在2D或隐式空间保持生成灵活性。

三个不同应用场景的团队不约而同做出相同的架构选择,这比任何单篇论文的消融实验都更能说明问题——它意味着混合空间表示不是某个特定任务的巧妙trick,而是让AI生成世界在物理上自洽的共性需求。如果你的团队正在做世界模型或3D仿真,现在值得回头审视自己的空间表示方案:是纯2D还是纯3D?这三篇论文从视频、游戏、机器人三个角度提供了具体论据,说明为什么混合路线更稳健,以及各自在哪个维度上做了取舍。