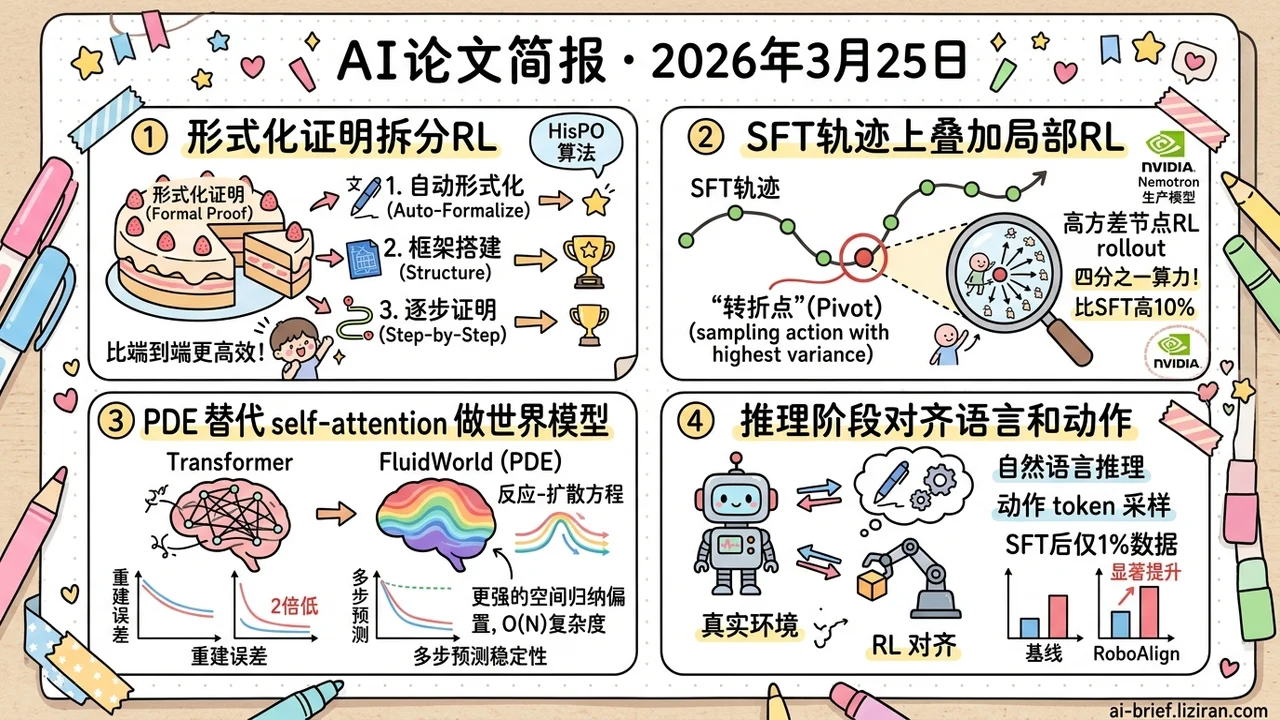

今日概览

- 形式化证明拆成三个独立能力分别RL,比端到端训练更高效——LongCat-Flash-Prover把自动形式化、框架搭建、逐步证明分开强化,配合HisPO算法解决MoE长链训练不稳定,方法论不绑定模型规模

- SFT轨迹上叠加局部RL,四分之一算力逼近端到端效果。 PivotRL只在高方差「转折点」做rollout,OOD任务比标准SFT高10%,已在NVIDIA Nemotron生产模型中落地

- PDE替代self-attention做世界模型预测器,重建误差低2倍: FluidWorld用反应-扩散方程提供空间归纳偏置和O(N)复杂度,多步预测稳定性显著优于Transformer

- 推理阶段对齐语言和动作,比训练时硬塞推理监督更靠谱。 RoboAlign在test-time用自然语言推理采样动作token再做RL对齐,SFT后仅1%数据即有显著提升

重点关注

01 推理 形式化推理做不好?问题可能出在你把它当成了一个任务

形式化证明一直被当作端到端任务来训练,但LongCat-Flash-Prover换了个思路:把它拆成三个独立能力——自动形式化(把自然语言翻译成Lean4语句)、框架搭建(写出证明骨架)、逐步证明。三个能力各自有独立的训练轨迹和RL优化,互不干扰。这个拆解之所以有效,是因为形式化证明的难点本来就不均匀:有时候翻译就卡住了,有时候证明策略才是瓶颈,混在一起训练模型根本搞不清该优化哪个环节。在agentic RL阶段,他们针对MoE模型在长链任务上的训练不稳定问题,提出了HisPO算法——用梯度掩码策略处理策略过期和训练推理引擎之间的差异,同时加入定理一致性检测直接卡掉reward hacking。对从业者来说,这套「先把复杂能力拆解成独立子任务、再逐个用agentic RL强化」的方法论,比560B这个参数量本身更有参考价值——完全可以迁移到你自己的复合推理场景,不管模型规模多大。

02 训练优化 Agent后训练的成本和泛化,未必是二选一

SFT和端到端RL在agent后训练中是两个极端——前者便宜但分布外(OOD)退化严重,后者泛化好但多轮rollout的算力开销扛不住。PivotRL的思路是在已有SFT轨迹上做局部on-policy rollout,只聚焦「pivot」——采样动作导致结果差异最大的关键中间步骤,在这些节点上叠加RL优化。配合功能等价奖励(不要求和SFT数据严格字符串匹配),让模型学到行为逻辑而非表面形式。四个agent领域平均比标准SFT高4.17%,OOD任务高10%,coding任务用四分之一的rollout量接近端到端RL的效果。已被NVIDIA的Nemotron模型采用于生产级后训练,做agent训练的团队可以直接参考这个「SFT轨迹+局部RL」的路线。

原文:PivotRL: High Accuracy Agentic Post-Training at Low Compute Cost

03 模型架构 用偏微分方程替掉Transformer,世界模型照样能预测

世界模型的预测器几乎默认选Transformer,这个前提很少被质疑。FluidWorld做了一个直接的实验:把self-attention换成反应-扩散方程(reaction-diffusion PDE),让物理扩散过程本身充当预测的计算基底,复杂度从O(N²)降到O(N)。在参数严格对齐的对比中(约800K参数,同样的编码器、解码器和损失函数),PDE方案重建误差低2倍,空间结构保持度高10-15%——更关键的是多步预测时Transformer和ConvLSTM都迅速退化,PDE方案保持连贯。这还只是proof-of-concept阶段(UCF-101 64×64,单张RTX 4070 Ti跑完),离实用场景有距离,但它提出的问题值得认真对待:世界模型的计算基底选择可能被过早锁定在了attention上。

原文:FluidWorld: Reaction-Diffusion Dynamics as a Predictive Substrate for World Models

04 机器人 推理对齐做不好,是因为塞错了地方?

给多模态大模型加VQA类推理监督来提升机器人操控,之前的尝试效果不稳定,甚至有害。RoboAlign换了个思路:不在训练阶段硬塞推理能力,而是在推理时通过自然语言推理采样动作token,再用RL优化这个推理过程,弥合语言理解和底层动作之间的模态鸿沟。SFT之后仅用不到1%的数据做RL对齐,在LIBERO、CALVIN和真实环境上分别提升17.5%、18.9%和106.6%——不过106.6%需要看基线的绝对水平,基线低的话翻倍并不难。方向上,test-time reasoning用于具身智能可能比训练时监督更务实,值得做机器人方向的团队留意。

也值得关注

今日观察

LongCat把形式化证明拆成三个子能力分别RL训练,PivotRL在已有SFT轨迹上做局部RL避免全量rollout——两篇论文处理的是同一个瓶颈:端到端agentic RL的计算成本太高。一个通过任务分解降低单次RL的复杂度,一个通过复用SFT轨迹降低rollout开销。

这里的信号不是「RL有用」——这点已经不需要论证。焦点已经移到怎么把RL的成本降到团队能承受的水平。对做agent产品的团队来说,这意味着不一定要等算力充足才能上RL。

盘点一下你现有的SFT数据和任务结构:如果任务可以拆成独立子能力(LongCat的思路),或者已有SFT轨迹中存在高方差转折点(PivotRL的思路),现在就可以开始小规模试验——不需要等到有足够算力做端到端RL。