今日概览

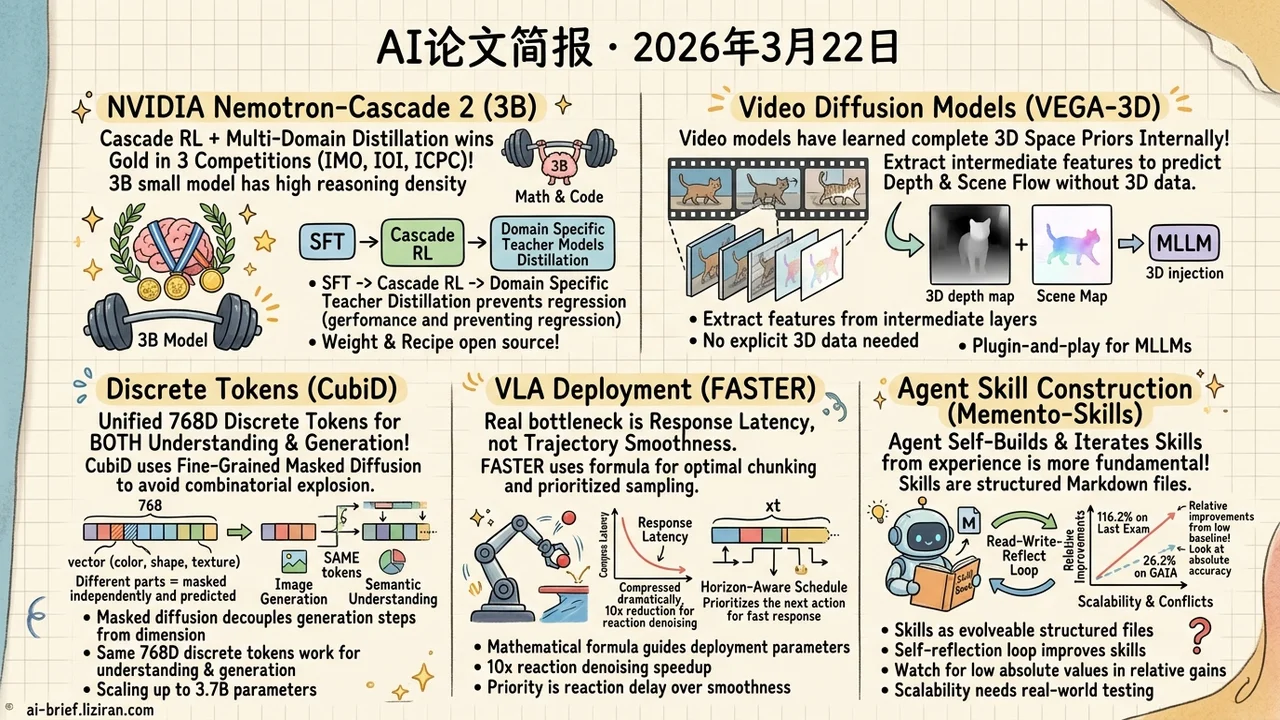

- Cascade RL加多领域蒸馏让3B参数拿下三项奥赛金牌,NVIDIA开源了完整训练配方,小模型推理天花板被重新定义

- 视频扩散模型内部已学到完整3D空间先验:无需3D标注或几何模块,直接提取中间层特征就能做深度和场景流预测

- 768维离散token同时服务理解和生成。CubiD用细粒度掩码扩散绕过高维组合爆炸,多模态统一架构少了一个关键障碍

- VLA部署的真正瓶颈是反应延迟而非轨迹平滑度——FASTER给出数学公式,将即时反应去噪压缩约10倍

- Agent自主构建和迭代技能比外部注入更本质,但百分比提升需要结合极低基线冷静看待

重点关注

01 训练优化 3B激活参数拿下三项奥赛金牌,关键不在架构而在训练配方

NVIDIA的Nemotron-Cascade 2只用3B激活参数(30B总参数MoE),就在2025年IMO数学奥赛、IOI信息学奥赛和ICPC编程决赛三项顶级竞赛中达到金牌水平——比同级别的DeepSeek V3.2 Speciale参数少20倍。核心突破不是MoE架构,而是一套精心设计的训练recipe:SFT之后进入cascade RL(级联强化学习),逐步扩展到推理、编码、agentic等多个领域,过程中针对每个领域引入最强中间教师模型做on-policy蒸馏。这个设计解决了RL训练中的经典难题——在一个领域推高性能时,其他领域往往会退步;多领域蒸馏相当于给每个领域设了一条保底线,在持续获得RL增益的同时防止回退。这是继DeepSeek之后第二个达到三项奥赛金牌的开源模型,但智能密度(每参数的推理能力)高出一个数量级。NVIDIA同时开源了模型权重和训练数据,对于想自部署推理模型的团队,这可能是目前最完整可复现的小模型训练参考路线。

原文:Nemotron-Cascade 2: Post-Training LLMs with Cascade RL and Multi-Domain On-Policy Distillation

02 多模态 不需要3D标注,视频生成模型就能理解空间?

直觉上,让多模态大模型理解三维空间,要么喂大量3D数据,要么加深度传感器和几何模块——反正得有显式的3D信息输入。但VEGA-3D发现了一个意外的捷径:视频扩散模型为了生成时序连贯的画面,已经在内部学到了完整的3D结构先验和物理规律。把这些中间层特征提取出来,通过一个门控融合机制注入MLLM,不需要任何3D标注就能做深度估计、法向估计和场景流预测。在3D场景理解、空间推理和具身操作基准上全面超过现有方法。这意味着3D理解的数据瓶颈可能被绕过了——不是造更多3D数据,而是去已有的视频模型里「挖矿」。

原文:Generation Models Know Space: Unleashing Implicit 3D Priors for Scene Understanding

03 图像生成 768维离散token让理解和生成共享同一套表示

8-32维和768维之间隔着一道组合爆炸的墙——离散视觉生成的token和理解任务的高维表示一直是两套体系,多模态架构也因此难以真正统一。CubiD(CVPR)直接在768维离散表示上做细粒度掩码扩散:任意维度、任意位置都可以独立遮蔽和预测,生成步数固定为T步,不随特征维度膨胀。900M到3.7B参数展现了清晰的scaling行为,ImageNet-256达到离散生成SOTA。更值得关注的验证是:离散化后的token在理解任务上保持了原始表示能力,同一套token确实能同时服务理解和生成。做视觉-语言统一架构的团队可以关注这个方向,但高维离散表示在更复杂场景下的泛化还需要更多验证。

原文:Cubic Discrete Diffusion: Discrete Visual Generation on High-Dimensional Representation Tokens

04 机器人 反应延迟才是VLA实时部署的硬指标

VLA(视觉-语言-动作模型)的异步推理方案一直在优化轨迹平滑度,但FASTER指出了一个被忽视的维度:环境变化后,模型多久才能做出反应。论文给出了一个清晰的数学结论——在action chunking策略下,反应时间服从均匀分布,由首个动作的推理延迟和执行步数共同决定,这个公式可以直接指导部署参数选择。基于这个分析,FASTER提出Horizon-Aware Schedule,让flow-based VLA在采样时优先收敛近期动作,将即时反应的去噪过程压缩约10倍(在π₀.₅和X-VLA上验证),同时保持长期轨迹质量。在真实机器人实验中——包括高动态的乒乓球任务——FASTER在消费级GPU上显著降低了有效反应延迟。

原文:FASTER: Rethinking Real-Time Flow VLAs

05 Agent 自己造的技能才好用?方向对了,数字还要再看

与其人工设计技能再注入,不如让Agent自己在任务执行中构建和迭代——Memento-Skills的核心逻辑就是这个。具体做法是用结构化markdown文件作为可演化的技能记忆,在RL框架下通过「读-写」反思循环持续自我重构,全程不碰LLM参数。思路更本质,但数字要冷静看:Humanity's Last Exam上116.2%的「相对提升」是从极低基线翻上去的,绝对准确率仍然很低;GAIA上26.2%的提升更有参考价值,但需要结合当前SOTA的绝对差距才能判断含金量。更关键的问题是规模化——技能库膨胀后路由效率会不会退化、技能间冲突怎么处理,这些在benchmark之外的真实场景里才能检验。

也值得关注

今日观察

视频生成模型里藏着没人用的3D先验,768维离散生成的障碍是变换方式而不是维度本身——这些发现的实际含义比技术细节更值得关注。在很多AI系统中,缺失的不是能力本身,而是提取能力的正确方式。

这对技术决策有直接参考价值。面对能力缺口,默认反应是加数据、加模块、加训练阶段。但如果能力已经编码在现有组件的中间表示里,这些增量投入就是在重复建设。更高效的做法是先做「能力审计」——用探针任务检测现有模型是否已经编码了你需要的信息。如果答案是肯定的,工程重点就该从「获取能力」转向「提取能力」。具体行动:下次为一个新能力立项前,先花一天用线性探针扫描现有模型的中间层,这可能比花一个月训练新模块的回报高一个数量级。