今日概览

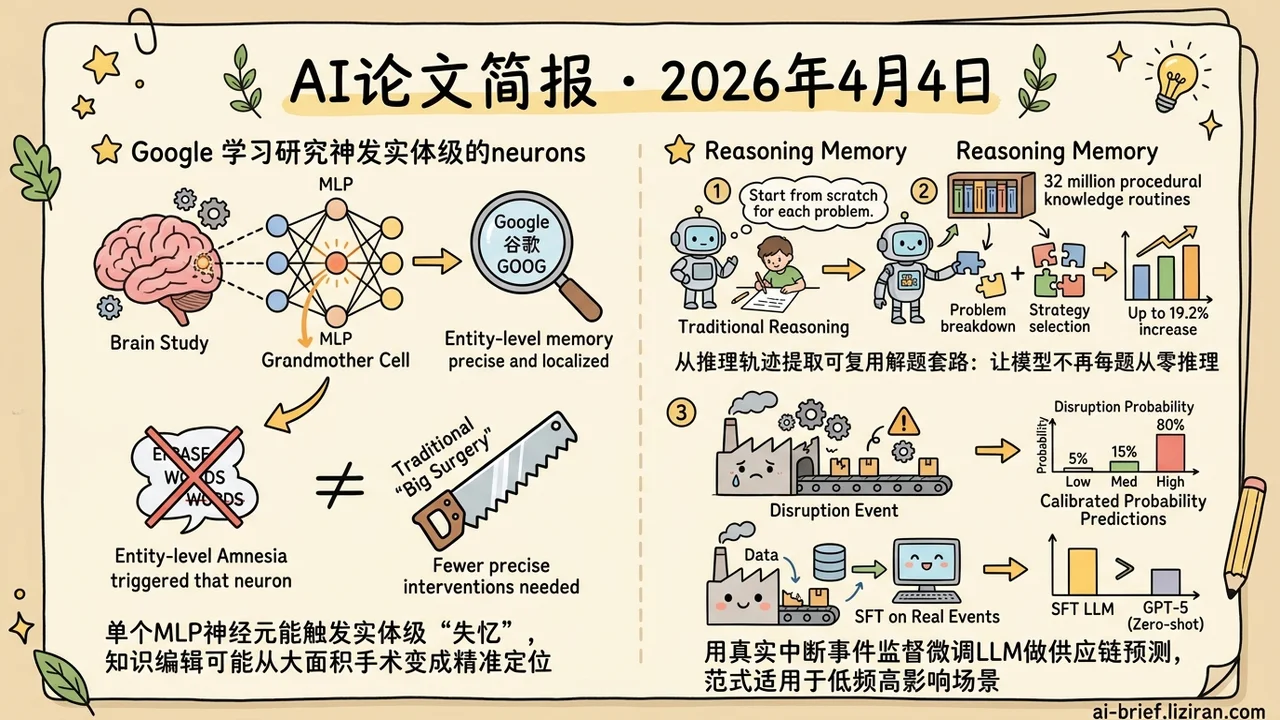

- 单个MLP神经元能触发实体级「失忆」,Google在200个实体上验证了因果关系,知识编辑可能从大面积手术变成精准定位

- 从推理轨迹提取可复用解题套路:3200万条程序性知识让模型不再每题从零推理,最高提升19.2%

- 用真实中断事件监督微调LLM做供应链预测,准确度和校准度显著超越GPT-5零样本。低频高影响场景的通用范式值得关注

重点关注

01 可解释性 单个神经元就能「记住」一个实体

LLM的知识到底存在哪——是均匀分布在整个网络,还是有精确的「开关」可以拨?Google团队在这个问题上拿到了一个出乎意料的答案:对于很多实体,MLP层里单个神经元的激活就足以恢复与该实体相关的事实预测。他们在200个实体上做了因果干预实验——消融特定神经元会导致「实体级失忆」,而在占位token上注入这些神经元的激活则能恢复正确的知识检索。更有意思的是,这些实体神经元集中在模型的早期层,而且对别名、缩写、拼写错误甚至多语言表述都保持响应,暗示模型内部存在某种「规范化」的实体表示。这和神经科学里争论了几十年的「祖母细胞」假说惊人地相似——大脑中是否存在专门响应「祖母」这类特定概念的单个神经元,现在在硅基网络里找到了实证。当然,200个实体的样本量不算大,研究者也承认并非所有实体都能找到可靠的单神经元映射,热门实体的覆盖率明显更高。但如果这个发现能推广,知识编辑就不再需要「大面积手术」——定位到早期层的具体神经元做精准修改,事实纠错和知识更新的成本可能大幅下降。

原文:Friends and Grandmothers in Silico: Localizing Entity Cells in Language Models

02 推理 让推理模型像老手一样积累解题套路

Test-time scaling的主流思路是每道题从头推理,不复用历史经验——有点像工程师每次遇到bug都从零排查。Mila提出的Reasoning Memory换了个路子:从已有的推理轨迹中提取「程序性知识」——怎么拆解问题、选什么策略、什么时候该回溯——构建了3200万条可检索的解题子程序库。推理时模型先把当前问题的核心子问题说清楚,再检索相关套路作为隐式先验,在数学、科学和编程六个benchmark上比无检索最高提升19.2%,比最强等算力基线提升7.9%。消融实验指向两个关键因素:源轨迹的程序覆盖面要够广,拆解-检索的粒度设计要让知识真正可复用。但这些套路在分布外问题上的泛化边界,还需要更多场景验证才能下结论。

原文:Procedural Knowledge at Scale Improves Reasoning

03 AI for Science 微调LLM做供应链预测,结果比GPT-5零样本强在哪?

这项工作的方法创新在于「用已实现结果做监督」——把真实的供应链中断事件作为训练信号,端到端微调LLM输出校准过的概率预测。难点是输入信号散落在非结构化文本中,而目标事件极度稀少,通用大模型的零样本推理很难从这种噪声中提取有效模式。微调后的模型在准确度、校准度和精确度上都显著超过GPT-5,而且自动习得了更结构化的概率推理方式,不需要额外的prompting设计。这条路径——用领域内已实现结果做监督训练预测模型——如果能迁移到金融风险、地缘事件等其他低频高影响场景,价值会大得多,但跨领域的泛化能力还需要验证。

原文:Forecasting Supply Chain Disruptions with Foresight Learning