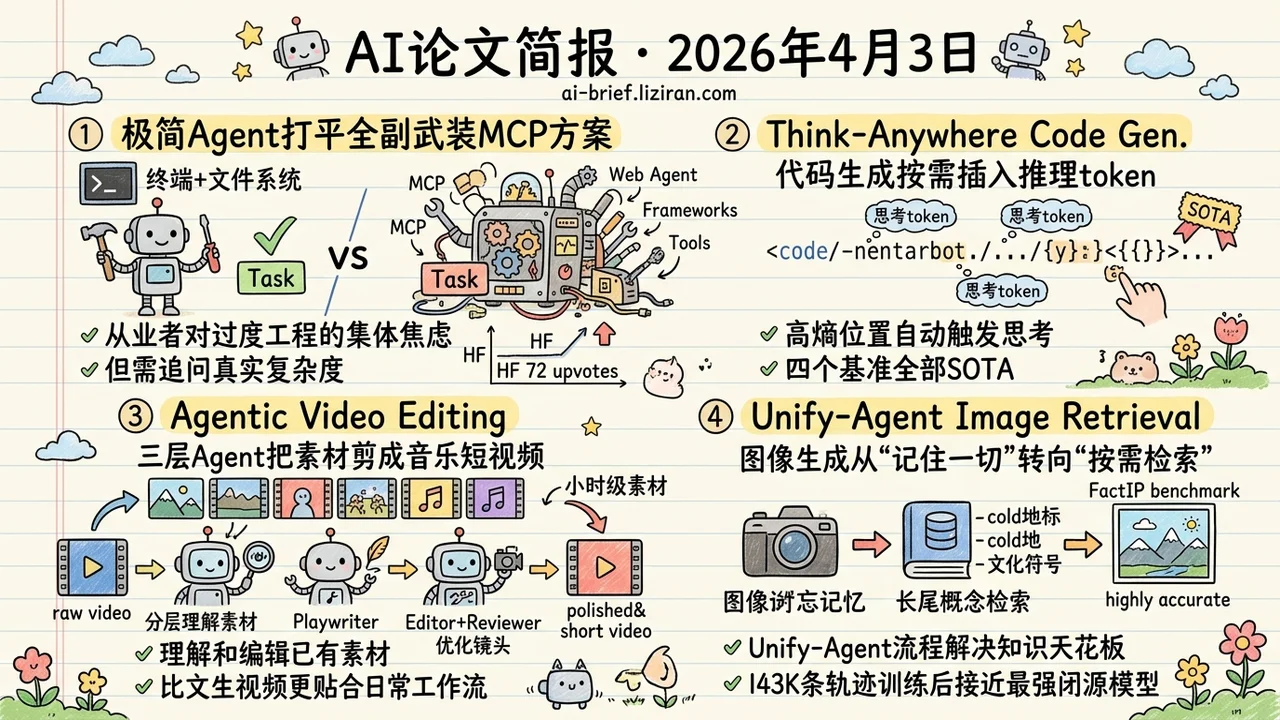

今日概览

- 终端+文件系统的极简Agent打平全副武装MCP方案,72个HF upvotes说明从业者对Agent过度工程的集体焦虑不是空穴来风——但评估任务是否覆盖真实企业场景的全部复杂度,仍需追问

- 代码生成按需插入推理token,四个基准全部SOTA:Think-Anywhere让模型在高熵位置自动触发思考,比先想后写更贴合编程中复杂度逐步暴露的认知节奏

- 三层Agent协作把小时级素材自动剪成音乐同步短视频。 不生成新内容而是理解和编辑已有素材,对创作者日常工作流的实际价值远超文生视频模型

- 图像生成从「记住一切」转向「按需检索」,Unify-Agent用agent流程解决长尾概念的知识覆盖天花板,143K条轨迹训练后接近最强闭源模型的世界知识水平

重点关注

01 Agent 全副武装的Agent,可能输给了一个终端窗口

行业正在热火朝天地给Agent堆料——MCP协议、浏览器操控、多角色编排、工具链注册,仿佛不够复杂就不够强。然后这篇论文说:给一个coding agent配个终端和文件系统就够了,企业自动化任务的表现匹配甚至超过那些重型方案。做法很直接:不走GUI,不走专用工具抽象,直接让模型写代码调API、读写文件、用命令行完成任务。72个HF upvotes说明这个极简主张准确戳中了从业者对「过度工程」的集体焦虑。不过需要冷静一下:论文中的「企业自动化」评估场景是否真的覆盖了现实世界的全部复杂度——权限管理、异常恢复、多系统联动——这些恰恰是简单方案容易碎掉的地方。但至少有一点值得认真对待:在基座模型足够强的前提下,复杂的Agent架构可能不是在解决用户的问题,而是在解决框架自己制造的问题。

原文:Terminal Agents Suffice for Enterprise Automation

02 代码智能 边写边想:推理模型为什么不该把思考全放在开头?

Think-Anywhere的思路很直觉:让模型在代码生成过程中任意位置插入推理token,而不是把所有思考都堆在开头。清华团队先用冷启动训练让模型学会这种「随时停下来想」的模式,再用基于结果的RL奖励让模型自主探索在哪里插入推理最有效。在LeetCode、LiveCodeBench等四个主流基准上都拿到了SOTA,超过现有的upfront thinking方法和近期的后训练方案。更有意思的是分析结果:模型倾向于在高熵位置(即不确定性最大的地方)触发推理,这说明它学到了「在该想的时候想」,而不是机械地分配计算量。

原文:Think Anywhere in Code Generation

03 视频生成 三个Agent接管剪辑流程,小时级素材自动出片

视频生成领域大多在追文生视频,但内容创作者日常更多的工作是剪辑——从几小时的原始素材中挑选片段、对齐音乐节奏、构建叙事。CutClaw把这个流程拆成了三层Agent协作:先用分层多模态分解同时捕捉视觉和音频的细粒度细节与全局结构,然后由Playwriter Agent编排叙事线,把视觉场景锚定到音乐节拍变化上,最后Editor和Reviewer Agent协作优化最终剪辑——按美学和语义标准精选镜头。这种拆解思路对应了真实剪辑工作流中的不同环节:理解素材、构建故事、精修成片。HF上40个upvotes反映了创作者社区对素材剪辑自动化的关注,但从摘要来看,具体在多长素材、多复杂场景下效果稳定,还需要看实验细节。

原文:CutClaw: Agentic Hours-Long Video Editing via Music Synchronization

04 图像生成 画不出没见过的东西?让生成模型学会「先查再画」

统一多模态模型在常见概念的图像生成上已经很强,但遇到长尾知识——比如特定文化符号、冷门地标——就容易「编造」,因为这些概念根本不在参数化记忆里。Unify-Agent的思路是把图像生成重构成一个agent流程:先理解prompt,再主动检索多模态证据,基于检索结果重新描述,最后再生成图像。团队构建了143K条agent轨迹数据做全流程监督训练,并推出了FactIP benchmark覆盖12类长尾文化概念来专门测试知识落地能力。在需要外部知识的生成任务上,Unify-Agent比基座模型有明显提升,接近最强闭源模型的世界知识水平——但这个「接近」的具体差距还需要看全文的细粒度对比。

原文:Unify-Agent: A Unified Multimodal Agent for World-Grounded Image Synthesis

也值得关注

今日观察

今天的四篇选题中,三篇都打着agentic旗号,但对任务复杂性的处理方式截然不同。

Terminal Agents主张极简:只给agent一个终端,让coding能力吸收全部任务复杂性,多余的工具抽象层反而是负担。CutClaw走相反的路,用Playwriter、Editor、Reviewer三个专职Agent显式建模剪辑工作流的每个环节。Unify-Agent选第三条路——不做多角色编排,而是给图像模型外挂检索和工具调用,把知识获取从参数记忆卸载到运行时流程。

分歧的本质是一个架构选择题:任务复杂性应该由谁承担?当底层模型足够强且任务可编码为代码时,简单接口反而更鲁棒,这是Terminal Agents的赌注。当任务涉及多模态感知和创意判断时,显式分工仍不可替代,这是CutClaw的立场。当瓶颈在知识边界而非推理能力时,外挂工具比堆参数更有效,这是Unify-Agent的判断。

一个实用的决策框架:启动agent项目前,先问你的任务复杂性能否被一段代码完整表达。能——先试终端级极简方案。不能——识别瓶颈是在多步协作还是知识获取,再决定是做角色分工还是挂载外部工具。