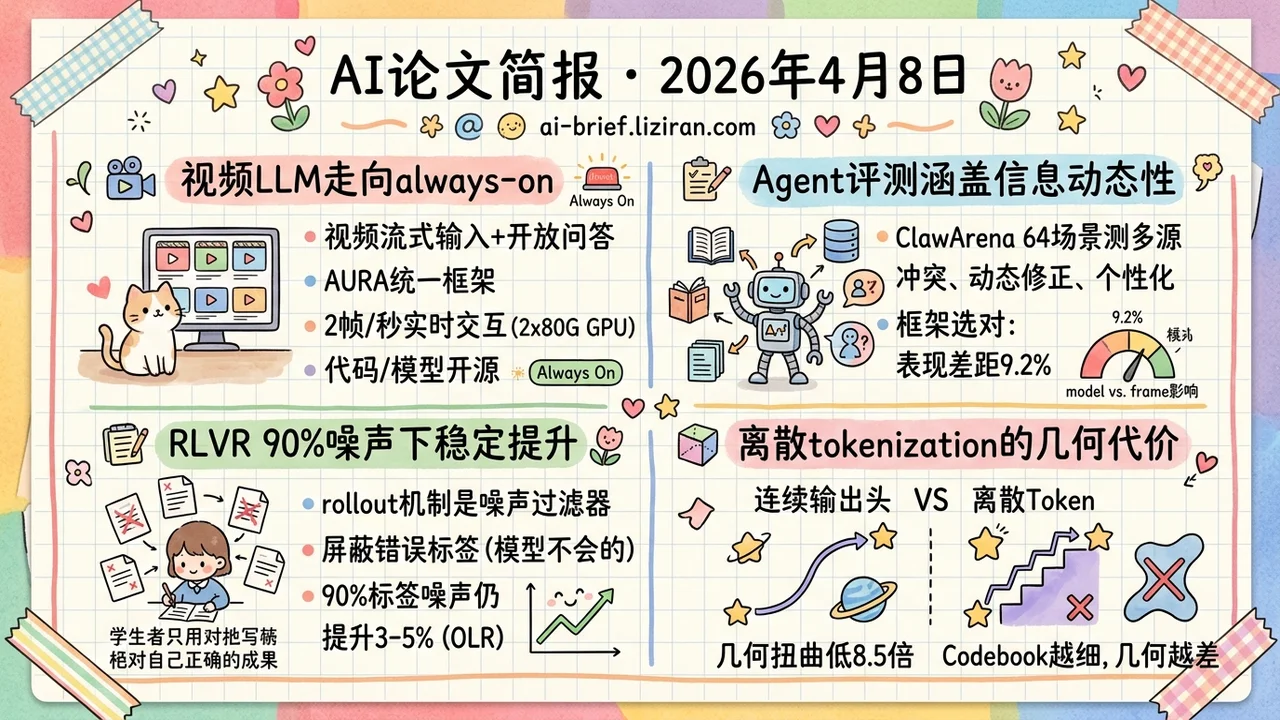

今日概览

- VideoLLM实现2FPS流式视频问答,AURA用端到端架构统一持续感知和主动响应,集成ASR+TTS已跑通可交互原型。

- Agent信息过时怎么办,ClawArena给出系统评测——64个场景覆盖动态更新下的信念维护,发现框架设计的影响接近模型能力差异的60%。

- RLVR的rollout条件天然过滤噪声标签。错误标签要生效需模型自行复现出错误答案,噪声比0.9时仍保持鲁棒。

- 测试筛代码的循环依赖用排序一致性打破,ACES只需pass/fail矩阵做leave-one-out AUC,零额外模型调用。

重点关注

01 多模态 视频理解终于从「传文件等回复」变成了「一直在看、随时能答」

视频监控、AR眼镜、直播互动——这些场景需要的不是「把视频传上去分析一下」,而是模型持续观察视频流并在合适的时机主动响应。AURA做的就是这件事:一个端到端的流式视觉交互框架,让VideoLLM能同时处理实时视频流、回答开放式问题、并在需要时主动说话。关键设计是把上下文管理、训练目标和部署优化统一在一个框架里,而不是用解耦的触发器去拼接「感知」和「响应」两个模块。具体来说,视频流是无限增长的但模型上下文窗口有限,AURA通过专门的上下文管理策略和数据构建方法让模型在有限窗口内维持对长时间视频流的稳定理解,而不是简单截断或周期性重置记忆。训练目标上同样需要精心平衡:持续感知要求不间断的低延迟视觉处理,而开放式问答和主动响应则需要在特定时机生成高质量文本输出,两者的训练信号密度和优化方向天然存在张力,AURA通过统一的训练框架协调这两类能力,使模型不会因为偏向一端而牺牲另一端。这和现有流式方案的解耦路线形成对比——后者通常用独立模块判断何时触发响应,但管线架构在开放式长程交互中容易因为触发模块的信息瓶颈而效果打折。实际跑起来的demo在两块80G显卡上做到了2FPS,集成了语音识别和语音合成,已经是一个可交互的原型系统。在流式视频理解的benchmark上拿到了SOTA,但更有意义的是它代表了VideoLLM从离线工具走向always-on助手的架构转变。

原文:AURA: Always-On Understanding and Real-Time Assistance via Video Streams

02 Agent 你的AI助手昨天说对的话,今天可能已经错了

部署过persistent agent的团队一定熟悉这个场景:两个数据源给出矛盾结论,用户通过纠正而非明说来透露偏好,昨天的正确答案因为新信息变得过时。ClawArena把这类真实部署痛点系统化成了benchmark——64个场景覆盖8个专业领域,1879轮评测中包含365次动态更新,专门考察agent在信息持续演变时能否维持正确信念。实验结果揭示了两个实用结论:模型能力差异(15.4%)和框架设计差异(9.2%)都显著影响表现,而信念修正的难度取决于更新的设计策略而非更新本身——换句话说,不是信息变了就难,而是怎么变决定了难度。值得注意的是,自演化技能框架(self-evolving skill)能部分弥补模型能力差距,这对选型预算有限的团队是个好消息。

原文:ClawArena: Benchmarking AI Agents in Evolving Information Environments

03 训练优化 RLVR自带噪声免疫?Rollout机制的意外收获

RLVR(基于可验证奖励的强化学习)训练推理模型时,有个一直被忽视的结构性优势:标签只有在模型自己通过rollout复现出对应答案时才会产生训练影响。这意味着错误标签要「生效」,模型得先自己独立推导出那个错误答案——这天然就是一道噪声过滤器,而且是监督学习不具备的。这篇工作首次系统分析了这个机制,将噪声标签分为「非活跃」(模型复现不出,只浪费数据)和「活跃」(模型恰好复现出错误答案,真正有害)两类。他们还发现了一个有趣的现象:训练早期,干净样本和噪声样本的准确率几乎同步上升,分化要到后期才显现。基于这个动态,提出的OLR方法在噪声比高达0.9时仍能保持鲁棒性,分布内任务平均提升3.6%-3.9%。

原文:Can LLMs Learn to Reason Robustly under Noisy Supervision?

04 代码智能 用LLM测试筛LLM代码,循环依赖怎么破

用LLM生成的测试去筛选LLM生成的代码,有个绕不开的问题:测试本身可能是错的,而判断测试对不对又需要先知道代码对不对——经典循环依赖。ACES的解法很干净:根本不需要判断测试的正确性,关键在于把测试投票从「计数」变成「排序」。具体做法是leave-one-out评估——留出一个测试,用剩余测试给代码排序,再看留出测试的通过/失败模式是否与排序一致,用AUC量化这个一致性作为测试权重。闭合形式的ACES-C在温和假设下可以证明逼近最优解,迭代优化的ACES-O则放宽了假设。两个变体都只需要二进制通过矩阵,计算开销可以忽略,在多个代码生成benchmark上达到了最优的Pass@k。

原文:ACES: Who Tests the Tests? Leave-One-Out AUC Consistency for Code Generation

也值得关注

今日观察

今天三篇分属不同领域的论文不约而同地拆掉了同一个隐含假设:「输入信号是干净的」。有意思的是,它们各自用了完全不同的机制来替代这个假设。

ClawArena的做法是把矛盾写进评测本身。365次动态更新不是噪声,是设计——benchmark主动制造信息过时和多源冲突,考察的不是agent能否获得正确信息,而是在信息必然不完美时能否维持合理信念。它用更新策略的难度梯度替代了「ground truth不变」的假设。

RLVR噪声研究发现了一个已经存在但没人注意到的天然机制。Rollout条件要求模型自行复现出答案才让标签生效,这意味着大部分错误标签根本无法激活——不是过滤噪声,是噪声自己走不进训练循环。监督学习没有这道门槛,所以同样的噪声比下表现差距巨大。

ACES则做了一个巧妙的问题转换:不问「这个测试对不对」,而问「这个测试和其他测试的排序是否一致」。Leave-one-out AUC把正确性判断变成了一致性度量,绕开了「需要知道真相才能评估工具」的循环。

三者的共同结论不是「我们需要更干净的数据」,而是「系统结构本身需要对噪声有正确的应对方式」。如果你正在搭建依赖外部信号的pipeline——不管是标注数据、测试用例还是实时信息流——值得审视一下:你的系统在信号出错时是直接崩溃,还是有结构性的容错机制?