今日概览

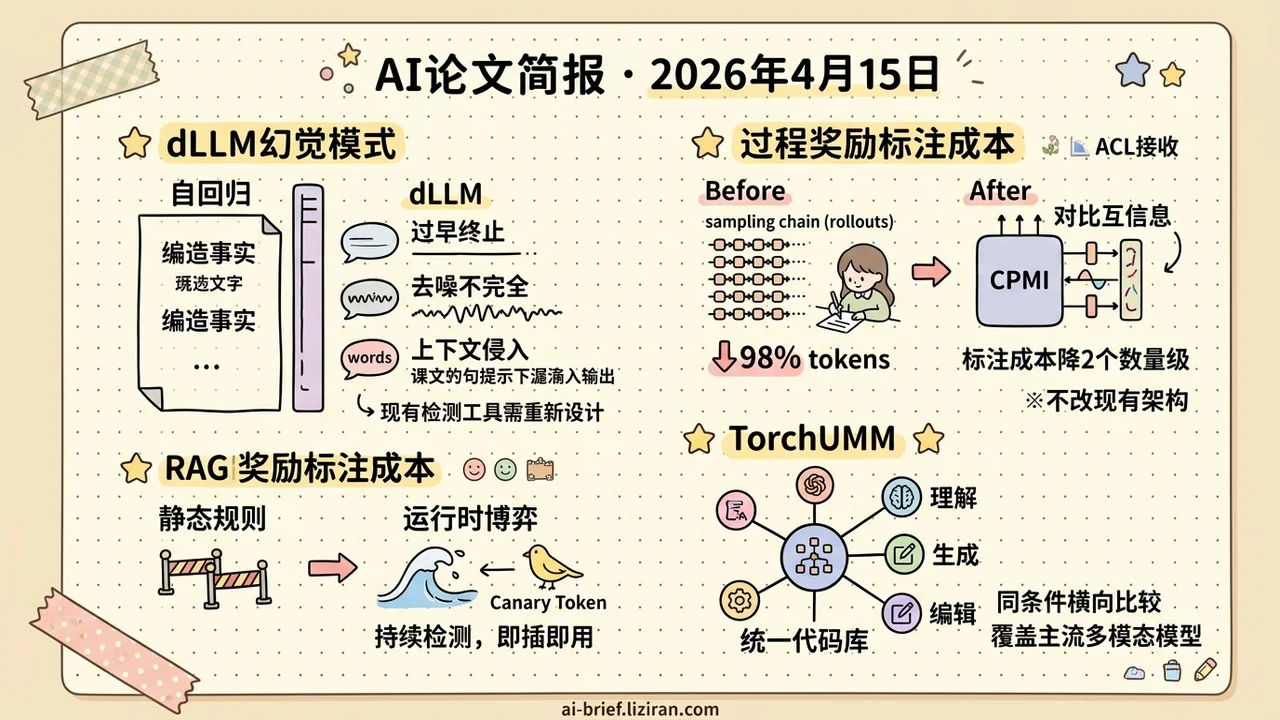

- dLLM的幻觉模式跟自回归完全不同,首个受控对比实验识别出三种特有故障模式(过早终止、去噪不完全、上下文侵入),现有检测工具需要针对性重新设计

- 对比互信息让过程奖励标注成本降两个数量级:直接从模型内部概率提取步骤级信号,不需要反复采样rollout。ACL接收

- RAG知识库防御从静态规则升级为运行时博弈。借鉴栈金丝雀概念嵌入canary token做持续检测,即插即用不改现有架构

- TorchUMM把主流多模态模型统一到一个代码库,覆盖理解、生成、编辑三维度,让不同架构第一次能做同条件横向比较

重点关注

01 模型架构 扩散语言模型的幻觉,错的方式跟自回归完全不同

dLLM(扩散语言模型)最近进展很快——上周DMax刚把并行效率翻了一倍,但效率之外还有一个基础问题没人系统回答过:dLLM到底会怎么出错?这篇ACL论文做了首个受控对比实验,架构、参数量、预训练权重全部对齐,发现dLLM的幻觉率确实高于自回归模型,但更关键的是错法完全不同。论文识别出三种dLLM特有的failure mode:过早终止(生成到一半就停了)、去噪不完全(输出残留噪声痕迹)、上下文侵入(把prompt内容混进生成结果)。这些故障模式跟自回归模型常见的「编造事实」型幻觉不重叠,意味着现有的幻觉检测和缓解工具放到dLLM上可能需要重新设计。推理时计算方面也有差异:准自回归生成会早期饱和,但非顺序解码展现出持续改进的潜力——这是后续提升dLLM可靠性的一个方向。对正在评估dLLM的团队来说,这篇论文的价值不在于说dLLM不行,而在于指出了需要专门应对的新问题。

02 推理 模型内部概率就能判断推理步骤好坏,何必反复采样?

对比互信息(CPMI)的思路很直觉:一个推理步骤好不好,看它让模型对正确答案的置信度提升了多少——再对比一组错误答案作为负样本,信号就更干净了。这个对比信号直接从模型内部概率算出来,不需要像蒙特卡洛估计那样反复rollout生成完整推理链。结果是数据集构建时间减少84%,token生成量减少98%,同时在过程级评测和数学推理benchmark上精度反而更高。ACL接收的工作,方法本身足够轻量——不需要额外训练,不需要大规模采样,对想在自己的推理任务上加过程验证的团队是一条现成的落地路径。

原文:Efficient Process Reward Modeling via Contrastive Mutual Information

03 安全对齐 RAG防御从「堵漏洞」转向了「持续博弈」

之前防RAG知识库泄露的思路基本都是静态的——过滤恶意prompt、限制输出格式、加访问控制。问题是攻击者会迭代试探,静态规则迟早被绕过。CanaryRAG换了个思路:借鉴软件安全中栈金丝雀(stack canary)的概念,在每次检索的文档块中嵌入canary token,把防御重新定义为一个双路径运行时完整性博弈——只要攻击者试图提取原始内容,canary的行为模式就会异常,实时触发检测。关键优势是即插即用,不需要重新训练模型或改动RAG架构,对正常任务性能和推理延迟的影响也很小。ACL接收,思路扎实,但实际效果还要看面对未知攻击策略时的泛化能力。

原文:Detecting RAG Extraction Attack via Dual-Path Runtime Integrity Game

04 多模态 多模态模型选型,为什么「苹果对苹果」的比较几乎不存在?

统一多模态模型(UMM)的架构越来越多,但每家的训练范式、实现细节、评估方式都不一样,想做公平横向比较基本靠手动对齐——费时且容易出偏差。TorchUMM试图解决这个基础设施缺口:把主流UMM统一到一个代码库里,覆盖理解、生成、编辑三个核心任务维度,提供标准化的评估协议和后训练接口。它集成了多种规模和设计范式的模型,评估涵盖感知、推理、组合性和指令跟随能力。这不是又一个benchmark排行榜,而是一个让不同架构在同一条件下跑起来的实验平台。对正在做多模态模型选型或对比研究的团队,值得关注它能否成为社区标准——但统一框架的覆盖度和维护活跃度还需要时间验证。

原文:TorchUMM: A Unified Multimodal Model Codebase for Evaluation, Analysis, and Post-training