今日概览

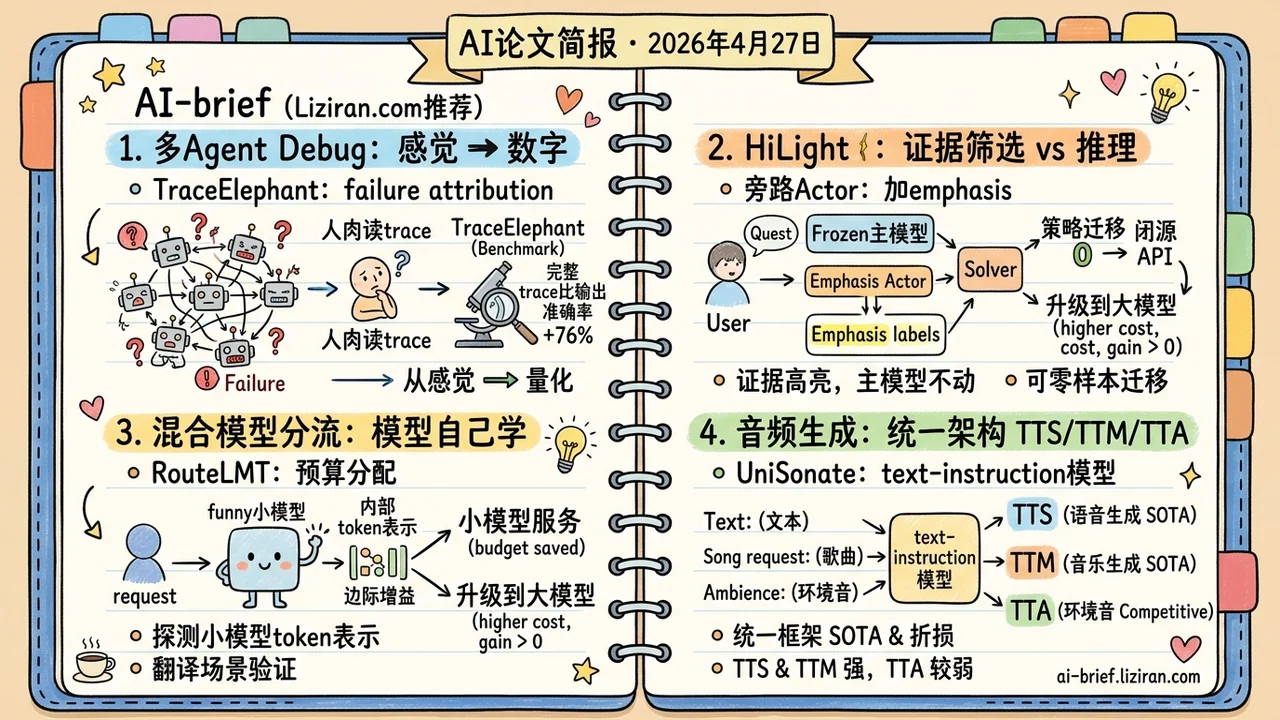

- 多agent debug从感觉变成数字:TraceElephant把failure attribution做成显式benchmark,完整执行trace比只看agent输出能把归因准确率提升76%。

- 主模型不动也能让关键证据被看见——HiLight训练一个旁路Actor在输入侧加emphasis,主模型frozen,学到的策略可零样本迁移到闭源API。

- 大小模型分流改成模型自己学,RouteLMT把「该不该升级到大模型」从手调阈值变成学marginal gain,信号只取自小模型自身的token表示——不过只在翻译场景验证。

- 音频生成补上统一架构这一课。UniSonate把TTS/TTM/TTA塞进一个text-instruction模型,前两类拿到SOTA、TTA仅competitive,统一带来的折损位置很典型。

重点关注

01 Agent 给多agent debug装上一把度量尺

多agent系统跑起来后最折磨人的不是任务失败本身——而是不知道是哪个agent的哪一步把整条任务带歪了。过去衡量MAS(多agent系统)只看任务级成功率,相当于把整个系统当黑盒,出问题之后调试全靠人肉读trace。TraceElephant把这件事做成了显式评测:给一段失败的多agent交互,系统能不能定位到责任agent和决定性步骤。一个关键发现是,提供完整的输入+上下文trace比只看agent输出能把归因准确率提升76%——这个差距说明开发者平时debug需要的信息,和现有benchmark给评测系统看的信息不在一个量级。Benchmark的覆盖度有限,真实生产中的故障形态会更杂,但failure attribution从「感觉」变成可量化指标这一步走通了,后面的归因方法才有了系统性比较的基础。

原文:Seeing the Whole Elephant: A Benchmark for Failure Attribution in LLM-based Multi-Agent Systems

02 推理 让关键证据「被看见」,主模型完全不动

HiLight的做法是把证据筛选和推理拆开:训练一个轻量的Emphasis Actor,在原始输入里给关键span加emphasis标签,主模型完全冻住,只在被标注过的输入上做推理。Actor用强化学习训练,奖励信号直接来自Solver的任务结果——不需要证据级标注,也不需要访问主模型权重。在长上下文问答和序列推荐两类任务上稳定优于prompt-based基线和自动化prompt优化方法,更值得注意的是学到的策略可以零样本迁移到没见过的Solver,包括API形式的闭源模型。对工程团队来说,这意味着可以把它作为一个前置加工层叠在GPT/Claude API前面,主链路完全不动。需要看全文确认的是Actor本身的训练成本和推理延迟。

原文:Learning Evidence Highlighting for Frozen LLMs

03 推理加速 大小模型分流的阈值,能不能让模型自己学出来?

翻译服务里常见的混部架构——小模型扛大头、少量请求升级到大模型——分流规则过去基本是手调的,按语种、长度、用户tier切阈值。RouteLMT把这件事重新框成预算分配问题:要预测的不是「这条请求难不难翻」,而是「大模型相比小模型到底能多带来多少增益」——marginal gain才是该用的信号。具体做法是探测小模型自身在prompt token上的内部表示来估计这个增益,不需要外接质量预测器,也不需要先把大模型跑一遍;论文报告在质量-预算的Pareto前沿上压过启发式和绝对质量估计基线。作者也承认存在回归风险——少数请求路由错了反而比小模型更差——为此加了个guarded变体来兜底。但所有实验都集中在翻译这个相对结构化的任务上,换到代码生成、对话、长文本这类开放domain能不能复制结论,还是问号。

原文:RouteLMT: Learned Sample Routing for Hybrid LLM Translation Deployment

04 多模态 把语音、音乐、音效塞进同一个模型,代价在哪一档?

音频生成长期是分裂的——TTS、TTM、TTA各自有自己的控制范式和数据格式。UniSonate把三类合到一个text-instruction驱动的flow-matching框架里,做法上跟前两年图像/视频走过的「统一架构」路线很像:用一个动态token注入机制把无结构的环境音投影到结构化的时序latent空间,再靠多阶段课程学习缓解任务间的优化冲突。结果是TTS和TTM都做到SOTA(WER1.47%、SongEval Coherence3.18),但TTA只是「competitive fidelity」——这正是统一模型最容易折损的那一档,也是判断这条路线能否落地的真正分水岭。值得注意的是论文报告了联合训练带来的正迁移,prosody和结构连贯性比单任务baseline更好,这比单点指标更有长期意义。但音频质量这种东西指标说了不算,做相关方向的团队最好先去demo页听一遍再判断折损是否可接受。

原文:UniSonate: A Unified Model for Speech, Music, and Sound Effect Generation with Text Instructions

也值得关注

今日观察

HiLight、CFB(2604.22335)、RouteLMT今天这三篇技术路线毫无交集——一个在输入侧给关键span加emphasis、一个在decoding时做水印式约束、一个在请求路由层做大小模型分流——但共享同一个工程假设:基座LLM不可动。三家选了三个完全不同的层介入,默认前提都是「权重冻结」。

这背后不是研究品味的趋同,是部署现实。基座迁移成本太高、微调降智的风险又一直没有可控的解法,「不动基座」在很多团队那里已经是默认前提。研究侧的工作分布因此也开始明显往「周边层」挤——围绕一个被当作API的固定主模型,在它的输入侧、decoding侧、路由侧各找介入点。

工程团队读paper的视角因此也得跟着变。评估一个新方法能不能落地,先看它假不假设你能动基座——如果假设你能动,无论指标多漂亮,都意味着要引入一条难以闭环的fine-tuning链路;如果假设基座frozen,再去估接入到现有商用API前后的额外成本和延迟。下次过外部研究的时候,不妨把「基座是否frozen」放到checklist第一栏。