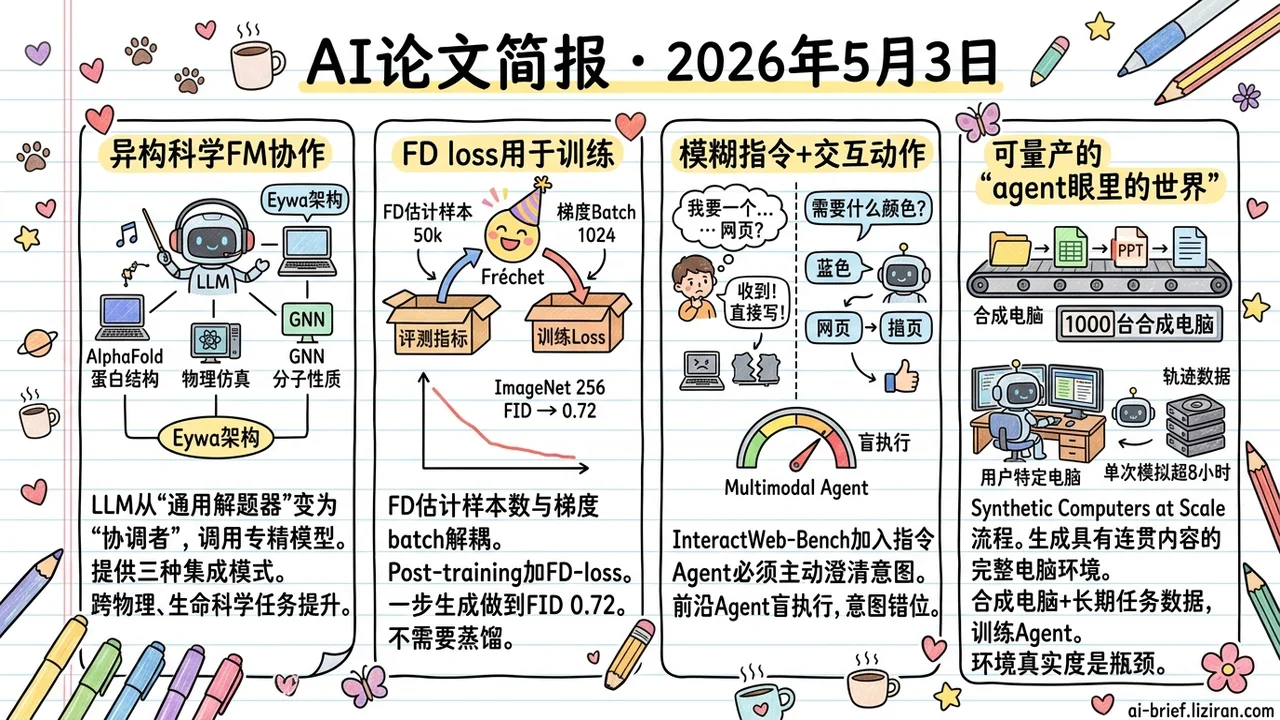

今日概览

- 异构科学foundation model协作,Eywa让LLM从「通用解题器」退回到协调者,把蛋白结构、物理仿真这类任务交还给领域专精的预测模型

- FD估计与梯度batch解耦:多年来只能当评测指标的Fréchet Distance真的做成了训练loss,post-training阶段一步生成在ImageNet 256上做到0.72 FID

- 模糊指令+交互动作空间——InteractWeb-Bench把「主动澄清意图」从可有可无变成必考项,前沿multimodal agent在这套测试下普遍陷入盲执行

- 可量产的「agent眼里的世界」。Synthetic Computers at Scale合成1000台用户特定电脑、单次模拟超8小时,长程agent训练的瓶颈从轨迹生成推到环境合成

重点关注

01 AI for Science 让LLM在该让位的时候让位

AlphaFold预测蛋白结构、神经算子做物理模拟、GNN算分子性质,这些科学领域的「底座模型」早就不止LLM一种,但现在大多数agent系统都假设所有信息能塞进自然语言里走一圈再吐出来。Eywa换了个思路:不是让LLM去硬啃结构化的科学数据,而是给那些已经在专门数据上训得很好的预测模型加一个「语言推理接口」,让LLM负责规划和决策,把实际预测交给领域模型。框架给了三种用法——单agent替换(EywaAgent)、嵌入现有多agent系统(EywaMAS)、以及planner动态协调的版本(EywaOrchestra),覆盖了从轻改到完整编排的迁移路径。实验跨物理、生命、社会科学多个领域,结构化数据任务上有提升,并且减少了对纯语言推理的依赖。值得保留的是:摘要里没给跨模型对接的失败模式和误差累积分析——异构agent系统的可靠性向来比单一benchmark数字要难处理,这部分需要看全文确认。

原文:Heterogeneous Scientific Foundation Model Collaboration

02 图像生成 把 FID 当训练 loss,缺的只是一个解耦

把 FD 估计用的样本数(50k)和反向传播用的 batch(1024)拆开——这篇就靠这一个改动,让多年来只能当评测指标的 Fréchet Distance 真的可以在表征空间里当 loss 优化。post-training 阶段加上 FD-loss,一步生成器在 ImageNet 256×256 上做到 0.72 FID;同样的 loss 还能把多步生成器直接转成一步,不需要蒸馏、对抗训练或 per-sample target。作者顺手发现 Inception FID 在现代表征下会和视觉质量错位,于是补了一个跨表征空间的指标 FDr^k。方法一句话能说清,但能解锁一整类做法——这种发现往往比新模型更值得关注。

原文:Representation Fréchet Loss for Visual Generation

03 Agent 用户讲不清需求时,前沿web agent还在闷头写代码

web开发类agent的评测一直默认输入是结构化、信息完整的需求文档,但真实非专业用户的指令充满歧义、冗余甚至自相矛盾。InteractWeb-Bench把这些被回避的变量塞回评测:四类用户agent加persona驱动的指令扰动模拟非专业用户的真实表达,再配一套Clarify/Implement/Verify/Submit的交互动作空间,允许agent反过来追问、验证、修正意图。实验里前沿multimodal agent普遍陷入「盲执行」——不主动澄清,按字面意思往下做,最后产出和用户真实意图错位。这个工作的价值不在又一个leaderboard,而在把「主动澄清意图」从可有可无变成必考项,把coding agent的失败模式从代码质量层面推到了意图识别层面。

原文:InteractWeb-Bench: Can Multimodal Agent Escape Blind Execution in Interactive Website Generation?

04 训练优化 给Agent造一台用得上的电脑,比造一条轨迹更难

做长程productivity agent的训练数据,真正卡脖子的不是怎么生成trajectory,而是agent打开电脑那一刻看到的世界够不够真——目录是不是像真人整理的、文档表格PPT之间内容是不是互相呼应。Synthetic Computers at Scale把这一层环境合成做成了可量产的流程:先合成一台用户特定的电脑(带完整文件系统和内容连贯的artifacts),再让一个agent给这位用户编出需要约一个月人类工时的productivity目标,另一个agent扮演用户在这台电脑上跨2000+轮、8小时以上去完成它。初步实验跑了1000台合成电脑,产出的经验数据在in-domain和out-of-domain评测上都带来了明显提升。和最近ClawGym那一类agent训练基础设施方向一致,但分工不同——这套管的是「agent眼里的世界长什么样」,不是agent自己怎么动。

原文:Synthetic Computers at Scale for Long-Horizon Productivity Simulation

也值得关注

今日观察

今天三篇切入点完全不挨边的论文撞在了同一件事上,而且各自指的具体位置不一样。Eywa看到的是:把蛋白结构、物理仿真这些已经成熟的领域foundation model硬翻译成自然语言再喂给LLM,丢失的结构信息LLM自己补不回来——所以agent loop里必须让出控制权,把「非语言的结构化预测」作为一等公民显式接进来。Visual Generation那篇五级taxonomy看到的是:再scale appearance mapping也撑不起空间一致性、persistent state、物理交互——视觉生成下一步要的是显式的world state,不是更逼真的像素。Intern-Atlas看到的是:论文引用图这层surface graph喂不动AI scientist系统——下一步必须把「方法之间的演化关系」显式建模成图,而不是继续在引用结构上做检索。三个scope完全不挨边,但落点高度一致:上面那层surface表征(自然语言、外观、引用)再加力气也撑不住下一步,关键是把下面那层structured representation拎出来明示。

给团队的动作:盘一遍你手上的pipeline,找到那个「再加数据/再大模型也只能再涨几个点」的地方——那通常就是下一层结构没显式化的位置。下一步是接入领域专精模型、改中间表征、或者把隐含结构变成一等公民,而不是继续在同一层 surface 上scale。