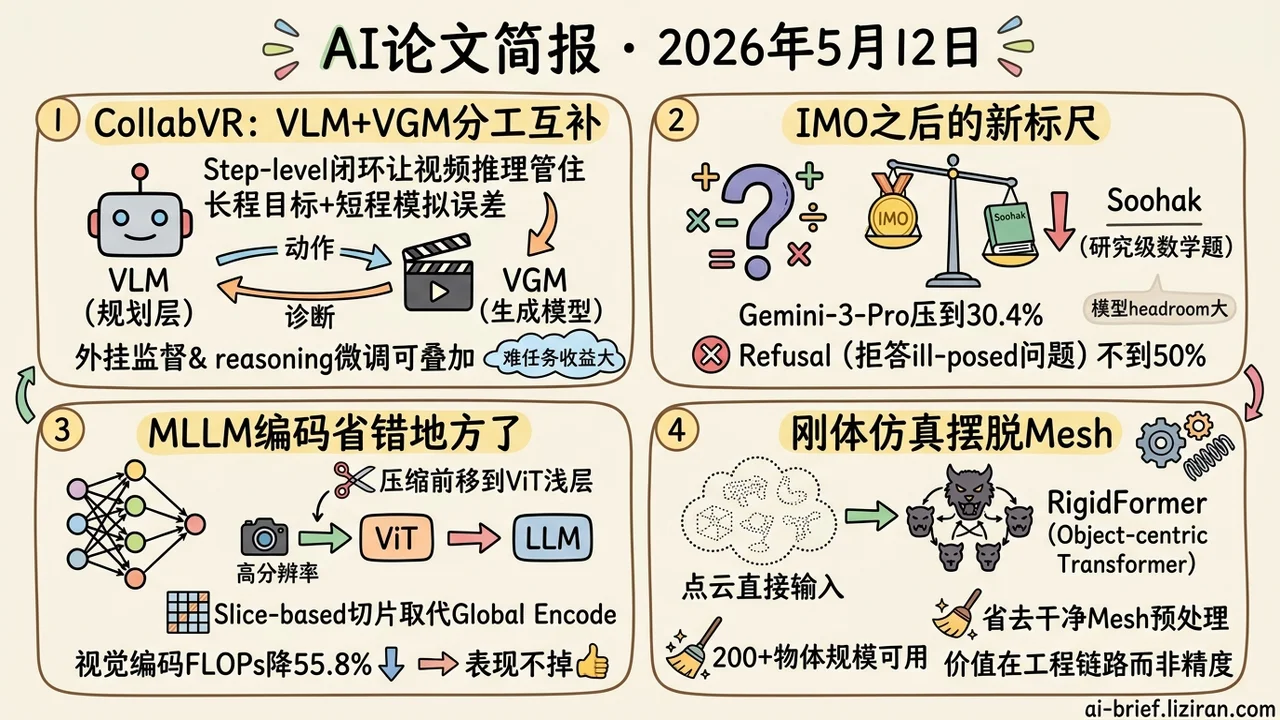

今日概览

- VLM+VGM分工互补,CollabVR用step-level闭环让视频推理同时管住长程目标和短程模拟误差,外挂监督和VGM自身的reasoning微调可叠加。

- IMO金牌之后的下一根标尺:Soohak用研究级数学题把Gemini-3-Pro压到30.4%,并把refusal(识别ill-posed问题主动拒答)单列出来,所有模型都不到50%。

- MLLM编码省错地方了——LLaVA-UHD v4把压缩前移到ViT浅层、用slice-based切片取代global encode,视觉编码FLOPs降55.8%而下游表现不掉。

- 刚体仿真摆脱mesh:RigidFormer用object-centric Transformer直接吃点云,200+物体规模可用,价值在工程链路而非精度天花板。

重点关注

01 推理 用视频做推理的真正瓶颈,不在视频模型本身

「Thinking with Video」这条线一直在跑——让视频生成模型(VGM)一帧一帧地推演物理过程或多步任务,把生成出来的Chain-of-Frames当作推理痕迹。问题是即便用最强的VGM,两个失败模式反复出现:长程任务上目标会漂移,单个clip中段的模拟误差会累积放大。CollabVR的判断是这两个问题都不该靠继续扩大VGM来解,而是补上一个显式的推理层——视觉语言模型(VLM)。架构本身不复杂:VLM在每一步规划下一个动作,看VGM生成的clip,把诊断结果直接折回到下一步的prompt里去修复。关键是粒度——既不是事前的整体规划(还没看到帧就commit),也不是事后的整体批判(介入太晚),而是step-level的闭环。在Gen-ViRe和VBVR-Bench上,越难的任务收益越大,且这套外挂式监督叠在已经做过reasoning微调的VGM上还能继续提升。

原文:CollabVR: Collaborative Video Reasoning with Vision-Language and Video Generation Models

02 评测 IMO金牌之后,数学评测的新轴是「该不该答」

Frontier模型今年陆续拿到IMO金牌之后,「数学能力」这个评测维度的区分度在迅速衰减——竞赛题考的是step-by-step解题,而真实数学研究是用reasoning去推进知识前沿本身。Soohak由64位数学家从零出题,规模439道,比此前的Riemann Bench(25题)和FrontierMath-Tier 4(50题)大一个量级。Challenge子集上Gemini-3-Pro 30.4%、GPT-5 26.4%、Claude-Opus-4.5 10.4%,开源模型普遍低于15%,头部到开源都还有大量headroom。更值得关注的是refusal子集:考模型能不能识别「题目本身ill-posed」并选择不答,所有模型都低于50%。这指向一个之前几乎没被显式优化过的训练目标——让reasoning模型学会承认「这道题不该有答案」。

原文:Soohak: A Mathematician-Curated Benchmark for Evaluating Research-level Math Capabilities of LLMs

03 多模态 高分辨率MLLM该优化的不是token压缩器

主流MLLM处理高分辨率图像的套路几乎成了默认动作:global encode拿到一长串视觉token,然后post-ViT compression压一压再送进LLM。LLaVA-UHD v4回头审视这个流程,指出一个容易忽略的事实——ViT的quadratic attention成本在你做token压缩之前就已经付完了,压缩省下来的只是LLM那一段的算力。作者沿两条轴改:encoding策略上,slice-based切片编码在多个benchmark上稳定超过global encode,说明保留局部细节比追求全局注意力更利于细粒度感知;压缩位置上,把压缩动作前移到ViT浅层(intra-ViT early compression),让真正的FLOPs下降发生在ViT内部。综合两点,视觉编码FLOPs降55.8%,下游表现持平甚至略升。需要看全文确认slice策略在视频或更长输入上的扩展性。

原文:LLaVA-UHD v4: What Makes Efficient Visual Encoding in MLLMs?

04 机器人 刚体仿真为什么一直离不开mesh?

学习式的刚体动力学仿真长期被绑在mesh加vertex级消息传递的路线上,意味着输入必须是干净的网格——点云、扫描数据这类mesh-free表征没法直接用。RigidFormer的做法是用object-centric Transformer替代vertex级交互,每个物体用一组紧凑的anchor表示,再通过Anchor-Vertex Pooling把局部几何信息注入anchor,避免在所有顶点之间做注意力。配合Anchor-based RoPE保持对anchor重排的不变性,再用可微Kabsch对齐把更新投影回刚体流形,保证物理约束不被神经网络破坏。效果上和mesh baseline打平或更好,能扩展到200+物体,并且对未见过的点云分辨率有泛化能力。对做机器人/物理仿真的团队来说,这放松的不是模型能力的天花板,而是输入端预处理的工程负担——值不值得换,要看你的数据管线里清洗mesh占了多少时间。

也值得关注

今日观察

Soohak和MLS-Bench同一天放出来,本质上是同一个动作的两个版本:把评测的目标从「应用现有知识」上移到「创造新知识」。一个让模型尝试推进数学未解问题,另一个让模型尝试发明可泛化、可扩展的ML方法——背后的共同假设是,前沿模型在IMO金牌、coding比赛这类「有标准答案的高难度任务」上的天花板正在显形,需要给「下一级」重新画一条线。

值得注意的是评测对象的层级位移:从problem-solving滑向method-invention。如果当前模型在「造方法」这一层只能拿到很低的分,那下一轮迭代该追的目标就不再是把竞赛分再刷高几个点,而是某种沿着「自己提出问题—自己设计方法—自己验证」链路走的能力。这条线的命中率会显著影响接下来训练数据怎么造、RL任务怎么设计。

具体建议:手上有reasoning模型或评测产品的,趁着这两个benchmark刚出,去申请远程评测或读一下refusal/方法发明这两类题目的具体形态,比单看分数更能感觉到这条标尺测的是什么;产品侧则可以重新审视「模型只是更会答题」还是「模型已经开始能提出新做法」,这两件事对落地形态的暗示完全不同。