今日概览

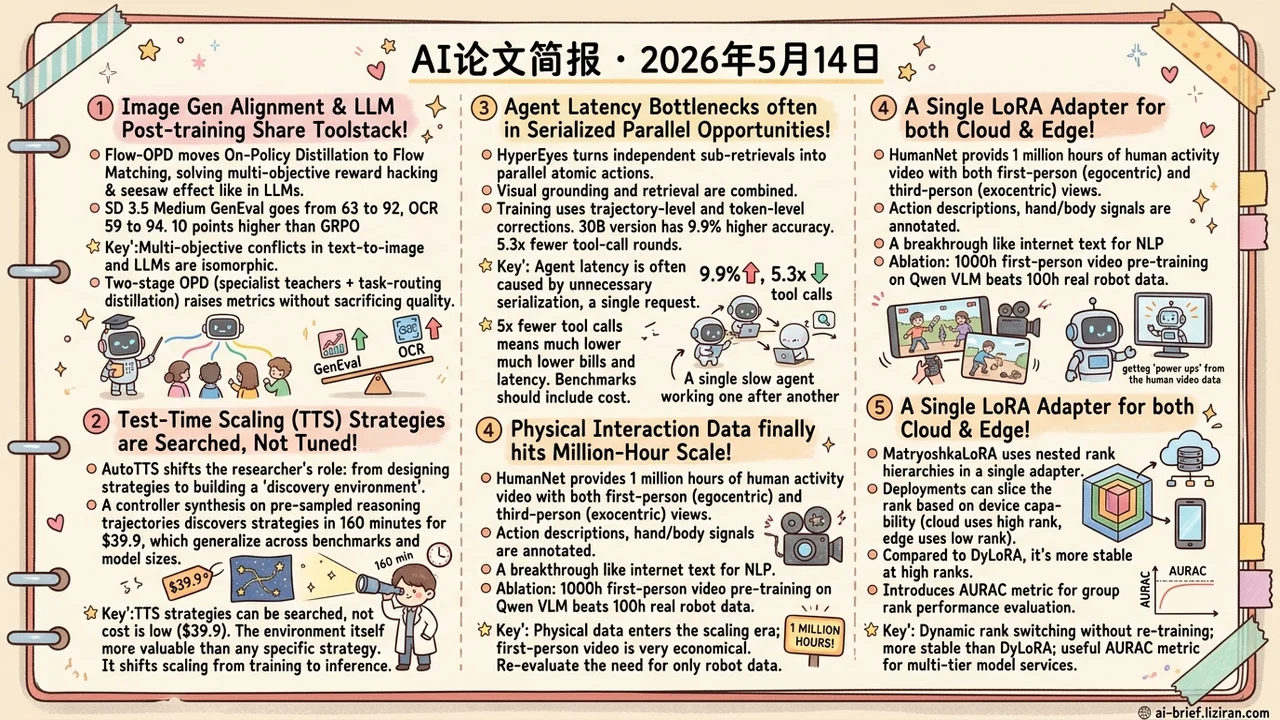

- 图像生成对齐和 LLM 后训练正在共享同一套工具栈:Flow-OPD 把 On-Policy Distillation 搬到流匹配,SD 3.5 Medium 上 GenEval 从 63 拉到 92、OCR 从 59 拉到 94,比直接跑 GRPO 高约 10 分。

- 测试时扩展策略可以搜出来而不是调出来:AutoTTS 把研究者的任务上移一层——不再设计策略,而是搭一个「发现环境」,160 分钟、39.9 美元搜到的策略能跨 benchmark 和模型规模迁移。

- agent 的延迟瓶颈常常在被串行化掉的并行机会,HyperEyes 把同一轮里独立的子检索改成并行原子动作,30B 版本准确率高 9.9%、tool-call 轮数少 5.3 倍。

- 物理交互数据终于进入百万小时量级:HumanNet 100 万小时人类活动视频,第一/第三人称双视角;1000 小时第一人称视频继续训练超过 100 小时真实机器人数据。

- 一份 LoRA adapter 同时给云端和边缘用:MatryoshkaLoRA 把 rank 改成嵌套层次,部署时按设备能力切档,相比 DyLoRA 在高 rank 端更稳。

重点关注

01 图像生成 当文生图开始用LLM的后训练工具栈

LLM后训练里有个经典问题:多个奖励信号互相打架,模型学着学着就开始reward hacking。流匹配(Flow Matching,目前主流的扩散类生成范式)做多任务对齐时遇到的麻烦其实是同构的——指标互相按下去抬起来的「seesaw effect」,本质上跟LLM的多目标对齐没什么两样。Flow-OPD干脆把LLM那边已经验证过的On-Policy Distillation整套搬过来:先用单一奖励的GRPO各训出一个专长教师,再用on-policy采样加任务路由把多个教师蒸馏到一个学生里,并加一项任务无关的「流形锚定」防止画质塌陷。任务路由比直接multi-reward GRPO关键的不同在于,后者把多个奖励加权成一个标量、在每个梯度步里挤压同一组参数,几个目标本质上是在抢梯度方向;OPD这边按样本派发到对应的专长教师做蒸馏,多目标被拆成样本维度上的硬切分,梯度不再互相抵消。流形锚定的直觉则是给生成轨迹加一道「不要偏离预训练自然图像分布」的兜底——硬按奖励推容易把模型滑到指标涨但画质崩的hack区,锚定项相当于把策略约束在已经学到的真实图像流形上做局部优化。在SD 3.5 Medium上GenEval从63提到92、OCR从59到94,比直接跑GRPO高大约10分。需要保留意见的是:摘要只展示了对seesaw的缓解,没给跨任务负迁移的量化边界,真正的扩展性还要看更多任务组合下的表现。

原文:Flow-OPD: On-Policy Distillation for Flow Matching Models

02 推理 把「调 TTS 策略」这件事自己外包给 LLM

测试时扩展(TTS,在推理时多花算力提升效果)这两年已经是标配,但策略一直是研究者手工设计的——什么时候分支、什么时候剪枝、什么时候停,全靠经验调启发式。AutoTTS 改的不是某个 trick,而是工作流:研究者不再设计策略本身,而是搭一个「发现环境」——把 width-depth TTS 形式化成在预采样的推理轨迹上做控制器合成,于是搜索过程不用反复调 LLM,发现成本压到 $39.9 和 160 分钟。结果是搜出来的策略在 accuracy-cost 曲线上跑赢手工基线,还能迁移到没见过的 benchmark 和模型规模。这套思路真正的看点不是数学推理上又涨了几个点,而是它把 scaling 时代的方法论——「不要直接优化结果,去搭一个能 scale 的发现过程」——从训练侧搬到了推理侧。当 inference 预算继续涨,谁先把「策略发现」自动化,谁就能吃到红利。

原文:LLMs Improving LLMs: Agentic Discovery for Test-Time Scaling

03 Agent 当多个查询其实可以并行,为什么要让 agent 一个个跑?

最近一批 agent 工作都在比谁「想得更久、链更长」,HyperEyes 反过来推了一把:把同一轮内相互独立的子检索改成并行发射。具体做法是把视觉定位(grounding)和检索融成一个原子动作,一次性派发多个带视觉锚点的查询,而不是按实体逐个 tool call。训练上分两层奖励:宏观用 TRACE 这种逐步收紧参考值的轨迹级奖励压住冗余调用,微观用 on-policy 蒸馏在失败 rollout 上注入 token 级的纠正信号,缓解稀疏 outcome reward 的 credit assignment 问题。30B 版本相比同档开源 agent 准确率高9.9%,平均 tool-call 轮数少5.3倍——后者对实际部署的延迟和 token 账单意义更大。作者还顺手做了个 IMEB benchmark,把推理成本和准确率一起评,因为现有 benchmark 普遍只看准确率,跑出来的「好 agent」经常是用调用数换分数。

04 机器人 具身智能终于有了自己的「互联网」

视觉和语言能 scale 起来,是因为互联网提供了天然的海量语料;具身智能(embodied AI)卡在数据上这么多年,本质就是缺这一层。HumanNet 给的就是这个底座:100万小时人类活动视频,第一人称和第三人称双视角,配上动作描述、手部和身体信号等交互导向的标注。1M小时这个量级才开始有意义——因为物理交互的长尾远比文本宽,几千几万小时只够刷 benchmark,覆盖不了真实世界的动作分布。第一/第三人称双视角是另一个关键设计:第一人称给操作细节,第三人称给场景上下文,机器人迁移时两个都要。最有意思的 ablation 是从 Qwen VLM 继续训练,1000小时 HumanNet 第一人称视频超过了100小时真实机器人数据——意味着拍人比拍机器人便宜十倍还有富余。

原文:HumanNet: Scaling Human-centric Video Learning to One Million Hours

05 训练优化 一份 LoRA adapter 同时给云端和边缘用,能做到吗

MatryoshkaLoRA的工程价值很直接:训练一次,部署时按设备能力切 rank——云端推理用高 rank 保质量,端侧用低 rank 省资源,不用为不同场景各训一份 adapter。做法是在原有 LoRA adapter 之间插入一个精心设计的固定对角矩阵 P,让所有子 rank(嵌套的低秩切片)都能在训练中拿到一致的梯度信号。这一点是和 DyLoRA 这类「随机采样 rank」方案的核心区别——后者高 rank 端容易掉点,因为不同 rank 看到的梯度不连贯。论文还提出了 AURAC(Area Under the Rank Accuracy Curve)这个指标,专门评估「一组 rank 上的整体表现」,比单点准确率更贴近实际部署需求。代码已开源在IST-DASLab/MatryoshkaLoRA。

原文:MatryoshkaLoRA: Learning Accurate Hierarchical Low-Rank Representations for LLM Fine-Tuning

也值得关注

今日观察

Flow-OPD 和 AutoTTS 今天看着不相干,但指向同一个具体动作:把 LLM 社区已经成熟的方法学反向移植回各自封闭的方向。Flow-OPD 直接搬 On-Policy Distillation 进流匹配的多目标对齐——OPD 本来是 LLM 后训练里用来调和异质奖励的工具;AutoTTS 搬的则是 scaling-law 时代那套「搭发现环境而不是调启发式」的工作流,把它从训练侧挪到了 test-time scaling 这一侧。

这不是 LLM 吃掉一切——两条路径本来都有自己的研究社区——而是 LLM 后训练和推理基建正在变成 AI 研究的通用工具箱。值得警惕的反面是:当下还在被维护成「图像生成专属技巧」或「推理专属 trick」的那些做法,可能只是没等到这层方法论被引进。一旦引进,原本被认为是该方向特殊性的部分,就会突然暴露出「只是当时没有更好的工具」。

具体可以做的事:拉一份你团队最近半年的技术债清单,挑出三条目前用启发式硬撑的环节,对每一条问一句——LLM 那边解决过类似形态的问题没有?如果有,迁移成本可能比想象中低,先做一个一周左右的可行性 spike,再决定是否纳入下季度规划。