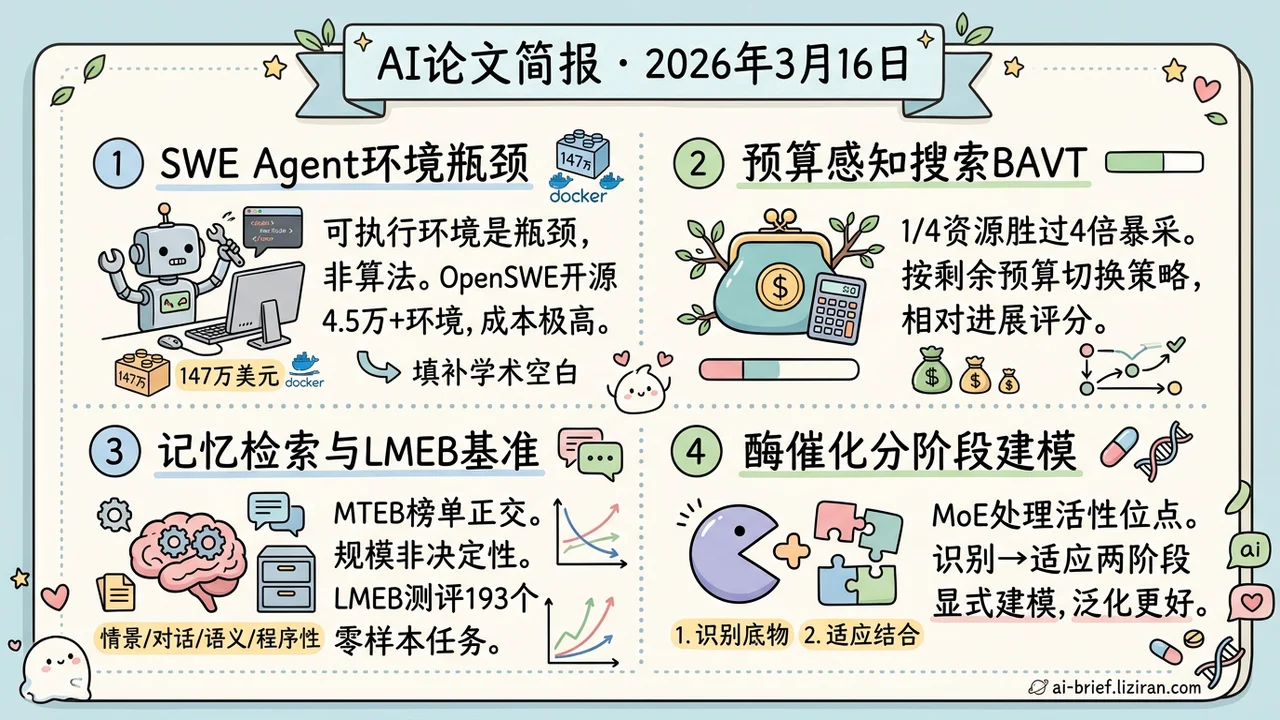

今日概览

- SWE Agent训练的瓶颈是可执行环境而非算法,OpenSWE开源45,320个Docker化训练环境,覆盖12,800+仓库,构建成本147万美元揭示了学术组难以独立填补这一基础设施空白。

- 预算感知的树搜索让Agent在1/4资源下胜过4倍暴力采样——用相对进展评分替代LLM自评,无需训练即可集成到现有Agent系统。

- 传统embedding基准成绩无法预测记忆检索能力。 LMEB覆盖四类记忆的193个任务,发现两个榜单表现正交,模型规模也不是决定因素。

- 酶催化的「识别→适应」两阶段被显式建模,MoE按活性位点类型路由,分布外泛化更好:对药物发现中的新型酶-底物组合更具实用价值。

重点关注

01 代码智能 SWE Agent从demo到量产,中间差的是一套147万美元的基础设施

目前公开可用的SWE训练环境规模有限,仓库多样性不足,绝大多数不提供可执行的动态反馈循环——Agent没有地方练习「改代码→跑测试→看结果→再改」这个完整闭环。OpenSWE试图用合成方法填补这个缺口:通过多Agent流水线在64节点集群上自动化生成Docker环境,最终产出45,320个可执行环境,覆盖12,800+个Python仓库,所有Dockerfile、评估脚本和基础设施全部开源。整个项目投入约147万美元(环境构建89万+轨迹采样58万),这个成本本身就说明了为什么学术组很难独立搞定SWE Agent训练基础设施。质量筛选是另一个关键设计:通过难度评估过滤掉过于简单或无法解决的实例,最终从约9,000个质量有保障的环境中提炼出13,000条训练轨迹。效果层面,基于Qwen2.5训练的OpenSWE-32B和72B分别在SWE-bench Verified上达到62.4%和66.0%,是该系列目前最优。一个值得留意的附带发现:SWE训练带来了域外能力的提升——数学推理+12分、科学基准+5分,这暗示代码环境中的迭代调试训练可能对通用推理有正迁移效果,做模型训练的团队值得关注这个信号。

原文:daVinci-Env: Open SWE Environment Synthesis at Scale

02 Agent 省着花token的Agent,效果反而超过4倍预算的暴力采样

线上跑Agent最现实的约束不是模型能力,而是token和工具调用的预算上限——跑飞了一次就把额度烧完。BAVT把剩余预算比例直接编码进搜索策略:预算充裕时广泛探索,快用完时切换为贪心执行,这个过渡是数学上可证明的最优,不需要额外训练或调参。另一个巧妙设计是用「相对进展」而非「绝对质量」来评估每一步——绕开了LLM自我评估普遍过度自信的问题,能可靠地剪掉冗余的工具调用。在4个多跳QA基准上,严格低预算下的BAVT超过了baseline在4倍资源下的表现。

原文:Spend Less, Reason Better: Budget-Aware Value Tree Search for LLM Agents

03 检索 Embedding在传统检索上的好成绩,能迁移到记忆检索吗?

MTEB这类主流embedding基准测的是「给一个query,找到相关段落」,但记忆增强系统面对的检索场景完全不同——信息是碎片化的,跨越长时间窗口,且高度依赖上下文。LMEB针对这个gap设计了193个零样本检索任务,覆盖情景记忆、对话记忆、语义记忆和程序性记忆四种类型,用22个数据集评估了15个主流embedding模型。最关键的发现是LMEB与MTEB的表现呈正交关系——在传统段落检索上排名靠前的模型,在长时记忆检索上未必占优。另一个值得注意的结论是模型规模不是决定性因素,百亿参数模型并没有稳定压过几亿参数的。

原文:LMEB: Long-horizon Memory Embedding Benchmark

04 AI for Science 预测酶催化效率,为什么单看序列匹配不够?

酶动力学参数预测(kcat、Km、Ki)的核心难点在于催化是一个分阶段过程——酶先识别底物,再通过构象变化适应结合,但现有方法大多把它简化成酶和底物之间的静态匹配问题。ERBA把这个过程拆成两步建模:先用交叉注意力机制捕获底物识别的特异性,再用几何感知的MoE(混合专家)架构处理活性位点的构象适应,不同口袋结构由不同专家处理。这个设计思路比较符合催化的生物学直觉——识别和适应本来就是两种不同的机制,硬塞进一个统一表示里会丢信息。在三个动力学端点上都有稳定提升,尤其是分布外泛化表现更好,说明分阶段建模确实帮模型学到了更鲁棒的特征。