今日概览

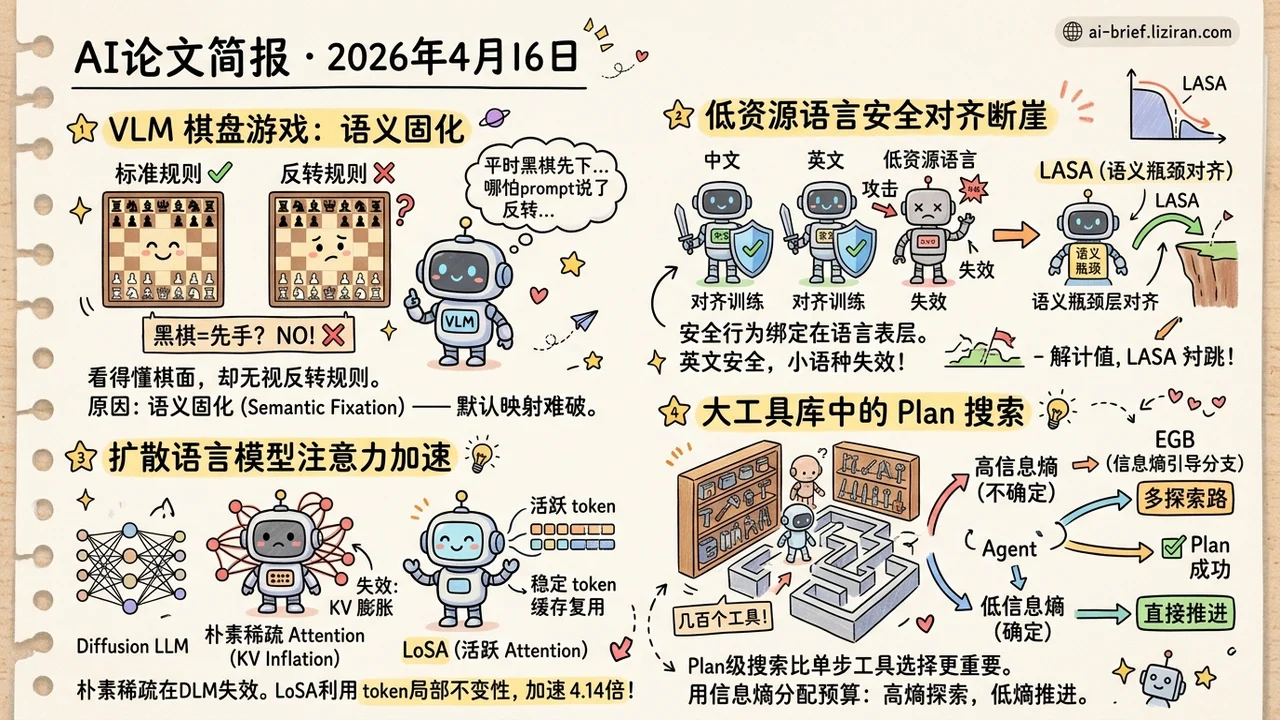

- VLM看得懂棋面,却无法遵循替代规则——14个模型在同一终局画面上,标准规则准确率显著高于反转规则,研究者将此命名为「语义固化」,对需要模型遵循自定义规则的应用是个警示

- 英文安全对齐在低资源语言下断崖式失效。 LASA在模型语义瓶颈层做语言无关对齐,将LLaMA-3.1的平均攻击成功率从24.7%降至2.8%

- 扩散语言模型上朴素稀疏attention直接失效,被mask token的KV膨胀是根因。LoSA利用去噪过程中token状态的局部不变性,实测加速4.14倍

- 大规模工具库中plan级搜索比单步选对工具更关键: Amazon用信息熵动态分配搜索预算,高不确定处多探索、低不确定处快推进

重点关注

01 多模态 同一个棋面换套规则,VLM准确率就崩了

14个VLM在完全相同的棋盘终局画面上,标准规则下的准确率一致且显著高于反转规则。这不是感知问题——模型看得懂棋面,但无法摆脱「黑棋=先手方」之类的默认语义映射。研究者把这种现象命名为语义固化(semantic fixation):即使prompt明确给出了替代规则,模型仍然倾向于保留默认解读。实验设计很干净:4种棋盘游戏、成对的标准/反转规则、相同的终局状态,精确隔离了感知失败和规则映射失败。干预实验进一步验证了这个机制——把棋子换成无语义负载的中性名称,反转规则下的表现明显改善;换回有语义的名称,差距又拉开。对做VLM应用的团队来说,这意味着如果你的场景需要模型按自定义标准做分类、标注或判断,感知能力达标不等于规则遵循能力达标,需要单独验证这一层。

原文:Beyond Perception Errors: Semantic Fixation in Large Vision-Language Models

02 安全对齐 英文安全不等于全局安全——低资源语言是对齐的盲区

LLM的安全对齐有个容易忽略的结构性问题:对齐训练主要用英文数据,安全行为实际上绑定在英文的语言表层,而非模型真正理解的语义层。结果是换一种低资源语言问同样的问题,攻击成功率可以从个位数飙升到两位数。LASA的思路是在模型内部找到「语义瓶颈层」——一个表征主要由语义而非语言身份主导的中间层——然后把安全对齐锚定在这里。实验结果扎实:LLaMA-3.1-8B-Instruct的平均攻击成功率从24.7%降到2.8%,Qwen2.5和Qwen3系列也稳定在3-4%。对做多语言部署的团队来说,这个思路比逐语言补数据更治本。

原文:LASA: Language-Agnostic Semantic Alignment at the Semantic Bottleneck for LLM Safety

03 模型架构 稀疏attention救不了扩散语言模型——除非找对该稀疏的token

扩散语言模型(DLM)的并行解码能力是它区别于自回归模型的核心优势,但长上下文下attention的显存瓶颈依然存在。直觉上稀疏attention是标准解法,但Berkeley团队发现它在DLM上直接失效:因为被mask的token在KV cache中共享相同的初始值,不同query选中的KV页面合集反而膨胀(论文称之为KV Inflation),稀疏反而引入了更多错误。LoSA的切入点是去噪过程中的一个经验规律——连续步骤之间大部分token的hidden state几乎不变,只有少量「活跃」token有显著变化。对稳定token复用缓存的attention结果,只对活跃token做稀疏attention,真正需要加载的KV索引大幅减少。在激进稀疏度下平均精度反而提升9个点,同时attention密度降低1.54倍,A6000上实测加速4.14倍。

原文:LoSA: Locality Aware Sparse Attention for Block-Wise Diffusion Language Models

04 Agent 工具越多,搜索策略比选对工具更重要?

多步任务中,Agent每一步面对的工具候选可能有几百个,搜索空间随步数指数膨胀。Amazon这篇先做了一个电商场景的大规模benchmark(SLATE),发现影响任务成功率的关键不在单步工具选择,而在plan级别的搜索效率和自我纠错。基于此提出EGB(Entropy-Guided Branching)——用模型预测的信息熵判断哪些决策节点值得展开更多分支:高熵意味着模型自己不确定,多探索几条路;低熵时直接推进,省计算。思路不复杂,但切中一个实际问题:工具数量上去之后,穷举不现实,纯贪心又容易卡死,需要动态分配搜索预算的机制。具体泛化性需要看全文确认,但用信息熵做exploration-exploitation平衡的思路,对构建大规模工具集成的Agent有参考价值。

原文:Long-Horizon Plan Execution in Large Tool Spaces through Entropy-Guided Branching