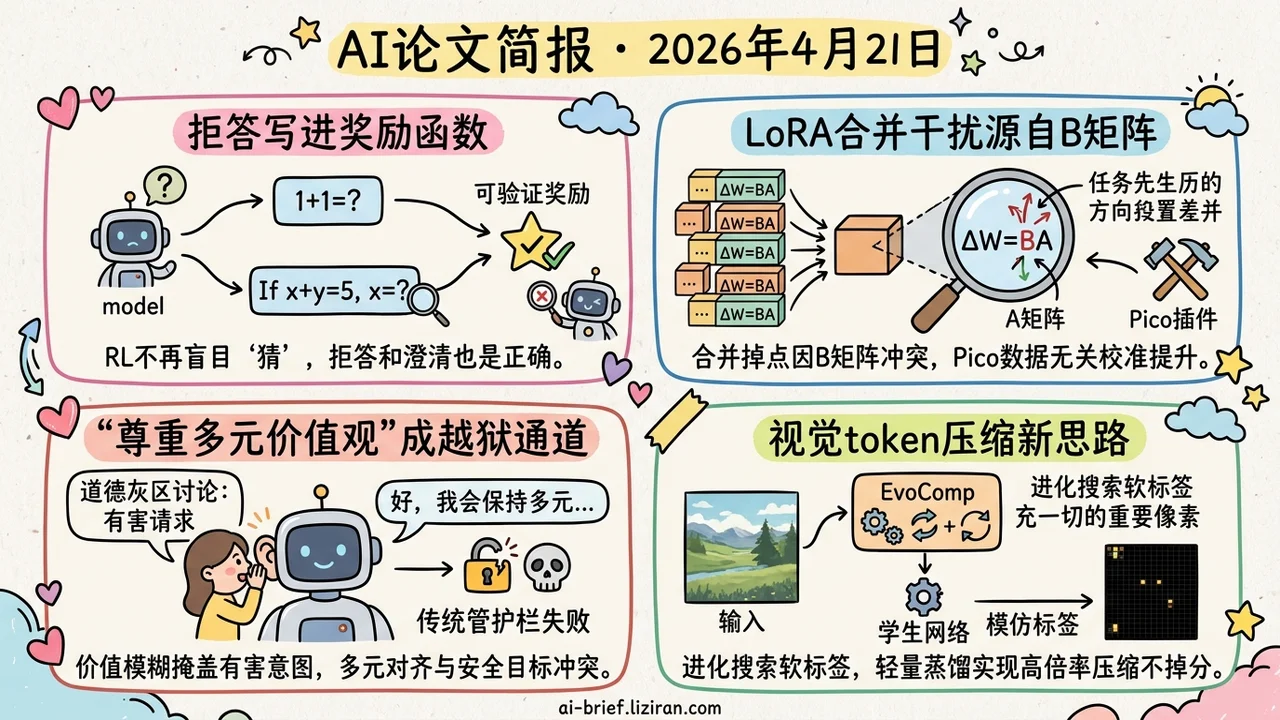

今日概览

- 把拒答写进奖励函数:Abstain-R1让可答与不可答共用一套可验证信号,3B模型在三个拒答benchmark上对齐DeepSeek-R1,而可答问题不掉点。

- LoRA合并的干扰其实来自B矩阵:Pico做data-free校准、作为插件叠加在TaskArithmetic/TIES/TSV-M上,八个benchmark平均提升3.4-8.3点。

- 「尊重多元价值观」成了越狱通道:把有害请求包装进「道德灰区讨论」,主流LLM和guardrail的越狱成功率显著上升;对齐目标之间的张力第一次被当成攻击向量。

- 视觉token压缩换思路:EvoComp先用进化搜索为每张图离线搜出「该保留哪些token」的软标签,再训轻量压缩器去模仿,3倍压缩保留99.3%准确率。

重点关注

01 推理 把「我不知道」写进奖励函数,3B就能追平DeepSeek-R1

RL微调能显著提升模型的推理能力,但有个不太被讨论的副作用:模型变得更「敢答」,碰到信息不全、本不该回答的问题,倾向于猜或编造而不是拒绝。常见的应对是在模型外面加一层过滤器,或者训练它输出通用的refuse模板,但这两种都没解决根本问题——模型自己分不清什么时候不该答,澄清的内容也没人验证是否真的指向了缺失的关键信息。Abstain-R1的思路是把「该答就答、不该答就拒绝并指出缺了什么」写进同一个可验证奖励:可答的问题验证答案对错,不可答的问题同时验证拒绝行为和澄清内容的语义对齐。3B模型在Abstain-Test、Abstain-QA、SelfAware三个拒答benchmark上做到了与DeepSeek-R1相当的水平,同时没有牺牲可答问题上的表现。对生产里跑RL微调的团队来说,这是一个值得注意的信号:abstain不是在模型外面再加一层的事,应该和正确性一起进奖励函数;至于「语义对齐的澄清」具体怎么写成可验证规则、在更开放的领域是否还成立,需要看全文确认。

原文:Abstain-R1: Calibrated Abstention and Post-Refusal Clarification via Verifiable RL

02 训练优化 LoRA合并的真正瓶颈不在ΔW,而在B矩阵

把多个LoRA adapter合并成一个通常会掉点,过去大家把这当成「任务冲突」问题,围绕ΔW=BA整体做各种融合算法。这篇的观察更具体:A和B的地位不对称——输出侧的B矩阵在不同任务间会反复使用一小撮共享方向,合并时这些方向被叠加放大,把任务特定信息盖掉了;而A矩阵本身就偏任务特定,不需要动。作者提出的Pico方法做的事很简单:合并前把B里过度共享的方向压一下,合并后再整体rescale,全程不需要数据。它是个插件,可以直接套在Task Arithmetic、TIES、TSV-M这些现有合并方法上,在数学、代码、金融、医疗八个benchmark上平均提升3.4-8.3个点。更有意思的是合并后的adapter居然能超过用全部任务数据训的单个LoRA。

原文:Crowded in B-Space: Calibrating Shared Directions for LoRA Merging

03 安全对齐 当「尊重多元价值观」本身变成越狱通道

Pluralism alignment(多元价值观对齐)是近两年对齐研究的主流方向之一——让模型学会在道德灰区里保持中立、尊重不同立场。这篇 ACL 论文做了一件让人后背发凉的事:把这个对齐目标本身当成攻击面。研究者构造了10.3K条「价值模糊」和「价值冲突」场景,把有害请求包装成「道德多元性讨论」,越狱成功率在主流 LLM 和 guardrail 模型上都大幅上升。有意思的点在于,问题不是模型训得不够安全,而是「对多元道德保持开放」和「拒绝有害输出」这两条对齐目标天然打架——越认真执行前者的模型越容易被后者的漏洞穿透。对齐目标之间的内部张力被明确当成攻击向量利用,这在越狱研究里是第一次。

原文:Jailbreaking Large Language Models with Morality Attacks

04 推理加速 视觉token压缩的新套路:先离线搜答案,再训模型模仿

MLLM视觉token压缩大多走启发式路线——按注意力权重或相似度剪枝,压缩比靠经验拍定。EvoComp把问题拆成两段:先用进化搜索为每张图离线搜出「保留哪些token能让输出损失最小」的软标签,再训一个轻量压缩器去模仿这组标签,本质是「先造好老师再蒸馏学生」。训练时额外做了难度均衡和语义分离约束,让保留/丢弃的token在语义上尽量拉开。3倍压缩下保留99.3%准确率,移动端推理加速1.6倍,CVPR接收。

也值得关注

今日观察

HeLa-Mem和OASIS今天一起出现,一个在agent长期记忆、一个在流式视频推理,领域完全不同,但两边都在拒绝同一种默认做法:把历史压成embedding向量,然后靠余弦相似度召回。HeLa-Mem把记忆组织成带Hebbian关联的图结构,让「一起出现过的东西」通过连接而不是相似度被一起取出;OASIS走的是层级事件路线,不扩context,而是按需从事件树里调取证据。

这两条路径技术上并不接近,但它们共同指向一个判断:当输入尺度继续增长——对话越来越长、视频越来越长——向量相似度检索作为唯一召回机制已经不够用了。问题不是embedding不好,而是当信息密度稀、冗余无界、且相关证据在时间上离散时,相似度不再是召回的正确判据。

对做长对话agent和长视频理解的团队,实际可做的事:在现有向量检索之上加一层结构化召回——可以是关联图、事件索引、甚至简单的时间段tag——先让结构召回收窄候选集,再让向量检索在小集合里做细粒度匹配。继续单靠堆embedding维度或扩context,ROI在快速递减。本周可以做的最小实验:在你的RAG pipeline里加一个「最近N个事件/会话」的结构召回通道,和向量召回并跑,看top-K里被结构通道挽救的query占比。