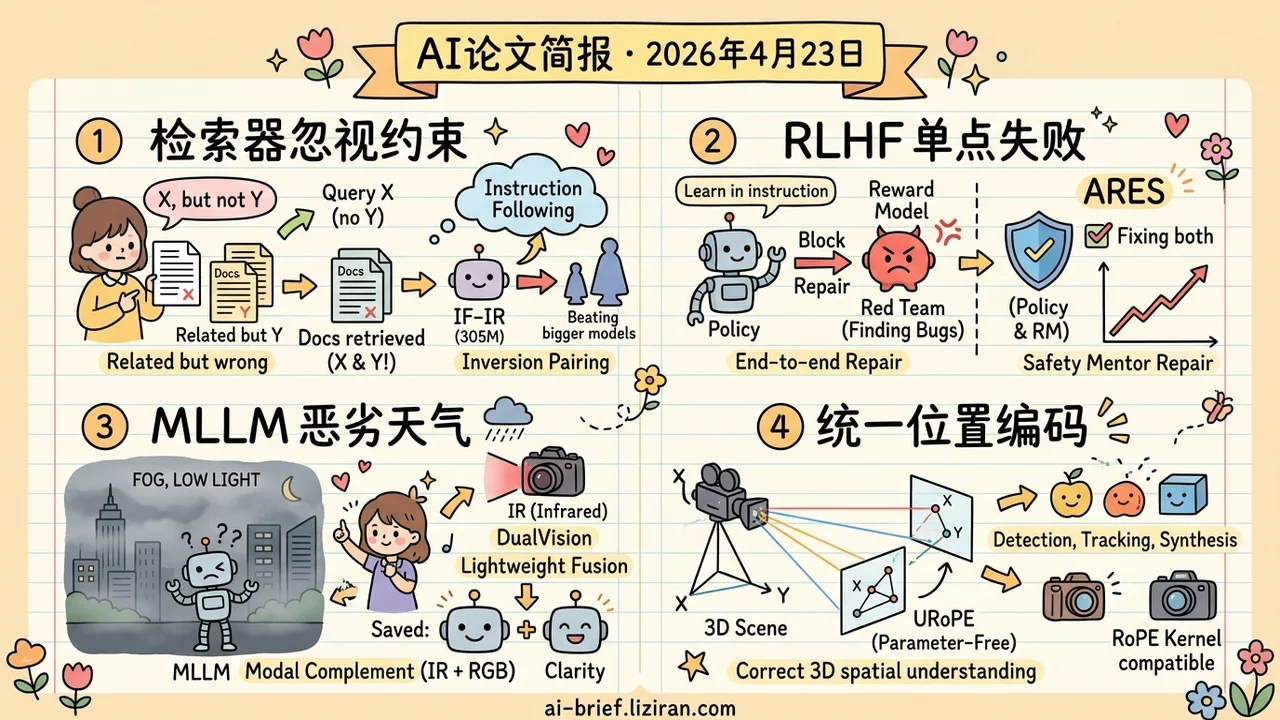

今日概览

- 检索器忽视指令约束是数据问题、不是模型容量问题:IF-IR用互补指令对+标签反转合成对比样本,305M encoder在FollowIR基准上提升45%,打赢参数量相当甚至更大的通用embedding。

- RLHF的单点失败藏在reward model里,ARES把红队从「发现漏洞」推进到「端到端修复policy-reward系统」,对真实在跑RLHF pipeline的团队更贴近工程需求。

- MLLM在雾天、低光、模糊下翻车,解法可能不在算法层。DUALVISION引入红外通道做模态互补,配套开源25K IR-RGB对齐图像和204K QA标注,降低在现有MLLM上试水的成本。

- 多视角和2D-3D之间一直缺一个统一的位置编码:URoPE沿相机射线采样3D点并投影回查询平面,parameter-free、兼容现有RoPE kernel,在novel view synthesis、3D检测、跟踪、深度估计上都有稳定提升。

重点关注

01 检索 检索器看得懂话题,但看不懂约束

做RAG的人大概都撞过这个场景:用户说「找关于X的文档,但不要来自Y」,检索器返回一堆和X相关的结果,完全没把排除条件当回事。根源在训练目标——现有检索器基本只优化「语义相关」这一维,对指令里的约束是否被满足几乎无感。这篇的切入点是在数据侧动手脚:给定一个query、一个同时满足话题和指令的正例、以及一个话题相关但违反指令的难负例,再让LLM反向生成一条互补指令,让同一对文档在新指令下正负例关系恰好翻转。同一对候选在两条互补指令下标签颠倒,模型就不得不真正通过指令去重新评估文档,不能再靠固定的话题线索蒙混过关。305M参数的encoder在FollowIR基准上提升45%,超过了参数量相当甚至更大的通用embedding模型;论文还指出数据多样性和指令监督是互补的——前者保住通用检索质量,后者负责指令敏感度。

原文:Dual-View Training for Instruction-Following Information Retrieval

02 安全对齐 红队找到漏洞之后,谁来补RLHF的单点?

RLHF里reward model是一个容易被忽略的单点失败——它漏判某类不安全行为,policy训练就会跟着漏,而过去的red-teaming基本停在「发现」环节,报告完漏洞就结束了。ARES把这个流程往前推一步:先用「Safety Mentor」组合topic/persona/tactic/goal四类结构化组件合成对抗prompt,同时暴露core LLM和RM的盲区;再做两阶段修复,先微调RM让它学会识别有害内容,再用改进后的RM去优化policy。修复后的鲁棒性到底有多扎实,光看摘要还不够,需要看全文benchmark细节才能下结论。但对真实在跑RLHF pipeline的团队,这种「发现+修复」一体化的范式比单纯的攻击评测更贴合工程需求——你最终要的是把问题补回系统的办法,不是一份漏洞清单。

原文:ARES: Adaptive Red-Teaming and End-to-End Repair of Policy-Reward System

03 多模态 视觉大模型在雾天低光下翻车,解法可能不在算法层

MLLM在干净的RGB图像上表现亮眼,但放到雾天、低光或运动模糊的场景,性能会明显掉下来——而这恰好是自动驾驶、机器人、监控这些高价值场景里的常见工况。DUALVISION没有继续在视觉backbone上堆数据增强,而是直接引入红外(IR)通道做模态互补,用一个轻量融合模块通过patch级局部cross-attention把IR和RGB信息合进MLLM。配套开源了25K对IR-RGB图像、204K的QA标注,以及500对的评测集DV-500,复现门槛相对低。论文称在多种视觉退化下都有稳定表现,但相较于「纯RGB+更强数据增强」路线的边际收益有多大,需要看全文确认。

原文:DUALVISION: RGB-Infrared Multimodal Large Language Models for Robust Visual Reasoning

04 模型架构 跨视角和2D-3D之间,位置编码该怎么算?

RoPE在1D序列和规则网格上已经是标配,但多视角视觉任务里一直缺一个统一的相对位置嵌入——查询patch和键patch处在不同相机坐标系,几何关系不能直接折算成像素距离。URoPE沿相机射线在若干预设深度上采样3D点,再投影回查询图像平面,这样就能复用2D RoPE的实现,同时自带相机内参感知和全局坐标系不变性。作者在novel view synthesis、3D检测、跟踪、深度估计四类任务上都看到稳定提升,覆盖2D-2D、2D-3D和时序场景。框架本身parameter-free,也兼容现有RoPE优化的attention kernel,接入改动不大。目前验证集中在相机视角之间,能否推广到点云、不规则mesh、图结构这类更一般的几何空间,还需要后续工作确认。

原文:URoPE: Universal Relative Position Embedding across Geometric Spaces

也值得关注

今日观察

IF-IR里最值得琢磨的不是那套互补指令对合成法本身——对比样本合成是老工具了——而是它如何把「检索器没学会看指令」这件事变成可以被证明的东西。论文先做了一个诊断动作:构造「同一对候选文档在两条互补指令下标签恰好翻转」的对照,如果模型对这对文档的相对打分在两条指令之间毫无变化,就说明它压根没把指令当回事,全靠话题相关性蒙混。这个对照一成立,问题就从「模型表现不够好」这种模糊抱怨,变成了「模型在指令这一维上输出近似常数」这种可量化的缺陷——一个可以被攻击、可以被补训的具体目标。

这个诊断思路值得借鉴的原因是,它卡住了从业者最常见的痛点:模型在benchmark上涨点、上了真实场景却翻车,到底是哪一维没学到?多数时候我们只能凭经验猜(「大概没学会长尾」、「大概被某个捷径特征带跑了」),然后扩数据、加regularization、换更大的模型,全是覆盖式打补丁。IF-IR给出的路径是反过来:先假设一个可疑维度,再设计一组「其他变量全固定、只让这一维反转」的对照输入,看模型输出是否跟着反转。跟不上,就证明这一维根本没进模型的决策——不用猜了,问题定位到了具体特征上。今天的ARES里能看到类似影子:自适应红队沿topic/persona/tactic/goal四个轴逼reward model露出盲区,本质也是在构造定向对照,只是换到了安全对齐的领域。

一个可以落地的动作:下次发现自家模型「线下涨点、线上翻车」时,先花半天想一个对照实验——把其他变量都固定、只让那个被怀疑的维度反转,看模型输出是否跟着反转。如果不跟着变,就说明它根本没学这一维,这时再去合成这一维的对比对训练,比继续扩数据更划算。