今日概览

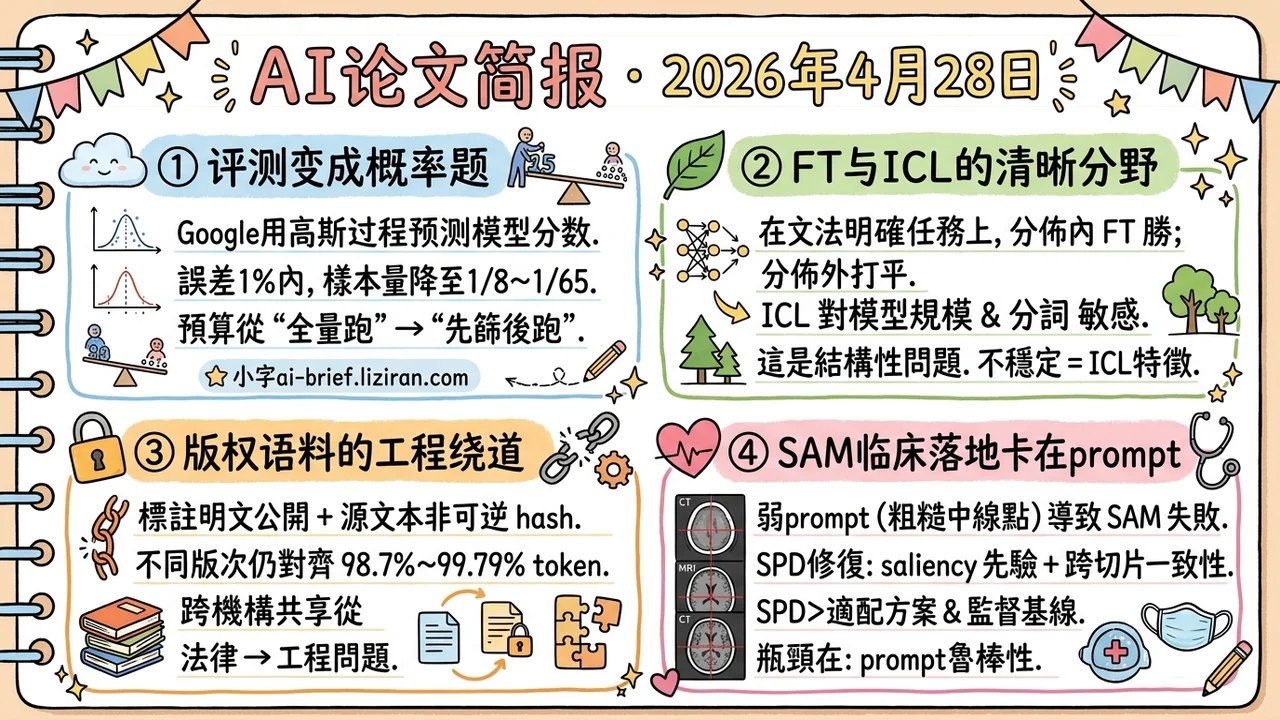

- 评测变成概率题:Google用预训练高斯过程当代理函数估计大模型在benchmark上的表现,1%误差下样本量降到原来的1/8到1/65,对照实验的预算结构从「全量跑」切到「先筛后跑」

- FT与ICL的清晰分野:在文法明确的形式语言任务上,分布内FT明显占优、分布外两者打平,ICL对模型规模和分词敏感是结构性问题而非实验噪声

- 版权语料的工程绕道:标注明文公开、源文本非可逆hash,跨版次仍能对齐98.7%-99.79%的token,跨机构共享从法律问题改写成工程问题

- SAM临床落地卡在prompt而非模型:saliency引导的解剖学先验加跨切片一致性约束,让SAM在粗糙中线点这类弱prompt下也能稳定分割

重点关注

01 评测 把benchmark评测变成概率题,省下8-65倍样本

完整跑一次大模型评测越来越贵:推理慢、人工打分贵,可选的benchmark还在不断扩张。Google这篇ProEval把性能估计变成贝叶斯求积分问题——用预训练的高斯过程当代理函数,「模型在某个benchmark上大概多少分」变成可以提前回答的问题,而不是每次都跑完。在推理、安全对齐和分类任务上,做到误差1%以内只需要8-65倍更少的样本,同时还能在更紧的预算下找出更多样的失败案例。从业者视角看,价值不是节省算力,而是评测预算的重新分配:用代理模型先筛掉那些「大概率没显著提升」的对照实验,把昂贵的人工评测留给真正不确定的区间。需要保留的疑问是迁移基础的稳定性——当模型架构跨代、或者新benchmark的分布偏离了高斯过程预训练时见过的分布,先验估计的可靠性就是这套方法的真实边界。

02 训练优化 FT vs ICL 之争为什么测不清?换成形式语言才看得见差距

之前 FT(微调)和 ICL(上下文学习)的对比研究结论一直不一致,主因是自然语言 benchmark 边界模糊、有数据污染嫌疑。这篇用形式语言做受控测试床——文法明确、字符串可采样、无训练数据泄露——并设计了一个判别式测试:模型必须对「语言内字符串」赋予比「语言外字符串」更高的生成概率才算真的掌握。结果分三层:分布内泛化 FT 明显强于 ICL,分布外两者打平;归纳偏置在低熟练度时相似,到高熟练度才分叉;ICL 对模型规模、模型家族和 token 词表都敏感,FT 则稳定得多。比起一次 A/B 测试,这种受控对照得出的结论更可迁移——尤其是 ICL 的不稳定性应当被当作固有特征,而不是实验设置的噪声。

原文:Fine-tuning vs. In-context Learning in Large Language Models: A Formal Language Learning Perspective

03 安全对齐 把语料共享的法律问题,变成工程问题

NLP里有个长期没解的实际瓶颈:高质量annotated corpus常常基于有版权的小说、新闻,研究者之间几乎没法合法地交换完整数据集。这篇ACL的做法是把语料拆成两部分——标注以明文公开,源文本用非可逆hash处理后一起发布。使用者必须自己合法持有原版材料,对手头的token应用同样的hash来匹配标注。关键是这个hash对版本差异有鲁棒性:不同版次的小说仍能对齐98.7%-99.79%的token。法律壁垒被改写成了工程问题,作者把实现开源为novelshare,做文学、新闻领域NLP的团队可以直接用。

原文:Overcoming Copyright Barriers in Corpus Distribution Through Non-Reversible Hashing

04 AI for Science benchmark上的精确点框和临床里的脏prompt不是一回事

SAM在医学影像benchmark上的成绩多数建立在精确prompt前提下,而临床工作流给的标注往往是粗糙的中线点——会漂移到相邻解剖结构,把SAM导向不一致或不完整的mask。SPD的修法是先用一个轻量saliency头学出数据驱动的解剖学先验,得到置信定位图作为锚;再用相邻切片的上下文去验证和补全噪声prompt,形成一组接近专家推理的共识prompt;最后加一个切片间一致性目标把局部解剖一致性约束进损失。在四个MRI/CT benchmark上,区域和边界指标都稳定超过现有SAM适配方案和监督基线。这条思路把foundation model落地到专业领域的瓶颈从「模型能力」挪到「prompt鲁棒性」,对临床部署来说,这一层的投入回报往往比模型微调更高。

原文:Learning from Noisy Prompts: Saliency-Guided Prompt Distillation for Robust Segmentation with SAM