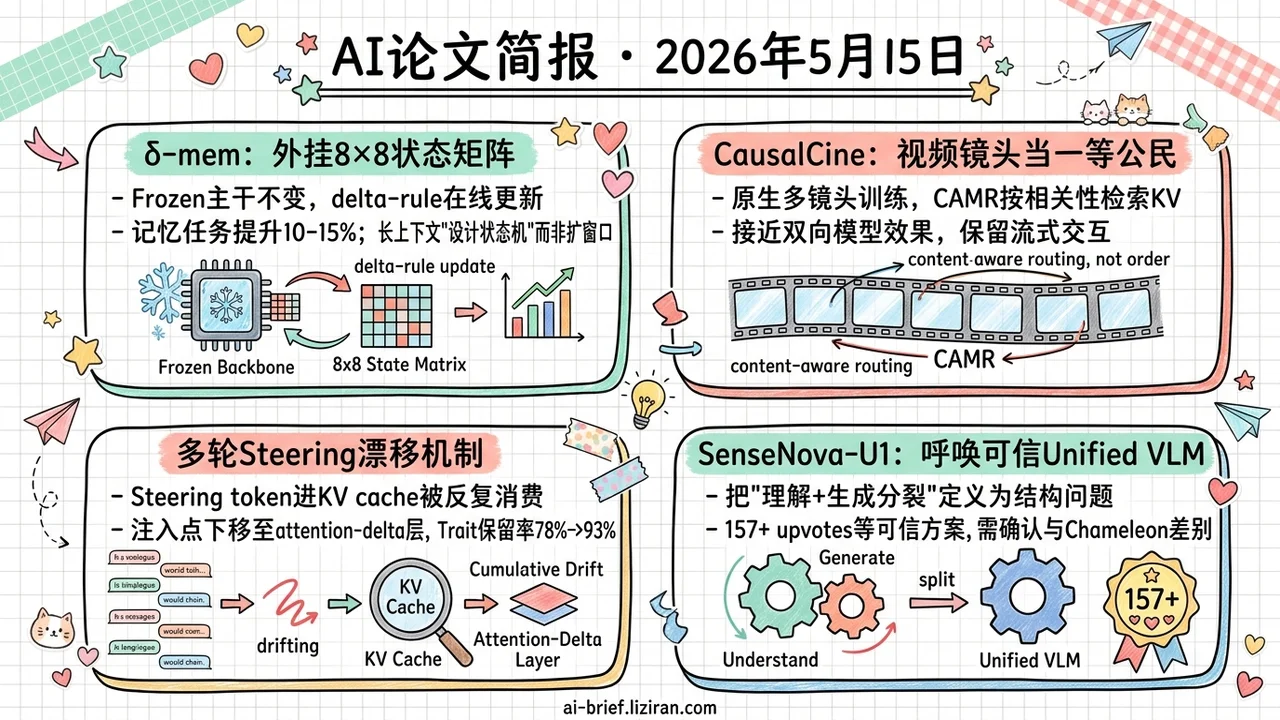

今日概览

- δ-mem外挂8×8状态矩阵:frozen主干不变、delta-rule在线更新,记忆密集任务上较基线提升10–15%,把长上下文从「扩窗口」重新表述为「设计状态机」。

- CausalCine把shot boundary当一等公民,原生多镜头训练加按相关性检索KV的CAMR,效果接近双向模型同时保留流式交互。

- 多轮activation steering漂移的具体机制:被steer的token写进KV cache后被反复消费成累积漂移,下移到attention-delta层后第10轮trait保留率从78%拉回93%。

- SenseNova-U1把「理解+生成分裂」定义为结构问题——157个upvote说明社区在等可信的unified VLM,但仅凭摘要难判断和Chameleon/Janus一系的实质差别。

重点关注

01 推理加速 8×8的状态矩阵能不能替掉越拉越长的context?

主流做长上下文这两年越来越偏算力——窗口越拉越大、KV cache越存越多,本质是用计算和显存换记忆容量。δ-mem把问题换了个问法:保留frozen的full-attention主干不动,外挂一个仅8×8的固定大小状态矩阵,用delta-rule在线更新,再把读出的内容以低秩修正的形式注入到注意力计算里。它的论点是把「记住更多」重新定义成「设计一个状态机」,而不是继续攒token。报出来的数字是相对frozen backbone平均提升10%、相对最强非δ-mem记忆基线提升15%;在记忆密集型benchmark上分别拉到31%(MemoryAgentBench)和20%(LoCoMo),同时通用能力没出现明显回落。对从业者实际意义在于:主干frozen意味着不用重训也不用换模型,挂载成本低,适合在已部署模型上做增量改造;但8×8这种极小状态究竟能撑多大规模的长程记忆,还需要更多场景验证。

原文:δ-mem: Efficient Online Memory for Large Language Models

02 视频生成 把镜头切换当一等公民处理的自回归视频模型

自回归视频生成长期卡在「把单镜头延长到极限」的范式里——长rollout下motion stagnation(动作停滞)和semantic drift(语义漂移)是已知通病,模型本质上把多镜头序列当成一个长单镜头来近似。CausalCine换了思路:在原生多镜头序列上训练causal base model,让模型显式学习shot transition,再用Content-Aware Memory Routing(CAMR,按注意力相关性而非时间邻近度检索历史KV)在有限活跃内存下维持跨镜头一致性。最后蒸馏成few-step生成器,做到实时交互——可以中途改prompt,不用重新生成已有镜头。论文称效果接近双向模型,同时保留了causal生成的流式交互性。

原文:CausalCine: Real-Time Autoregressive Generation for Multi-Shot Video Narratives

03 可解释性 activation steering在多轮对话里被KV cache放大成漂移

做personality或safety steering的人都遇到过:单轮prompt上效果挺好的干预向量,丢到多轮对话里跑十轮就开始失控。一般的归因是「强度没调好」。这篇给出了一个更具体的失败机制:被steer过的token状态会写进KV cache,后续每一步注意力都在重复消费这个被扰动过的表征——一次局部干预被cache放大成累积漂移。诊断成立之后解法就顺了:把干预从residual stream下移到attention-delta层,并按token做门控,让steering只走模型本来用来「听prompt」的那条通路。多轮benchmark上coherence drift从-18.6拉回到-1.9,第10轮的trait表达从78.0升到93.1。

原文:Prompt-Activation Duality: Improving Activation Steering via Attention-Level Interventions

04 多模态 又一个「统一多模态」,这次不一样吗?

「理解和生成本应是同一个过程」——这话过去两年从Chameleon到Janus到Show-o已经听过不止一次,每次都说要消除分裂,但落到实现层面常常还是pipeline拼接换了个说法。SenseNova-U1的论点有意思的地方在于它把这种分裂明确定义为「结构限制而非工程产物」,这个表述本身比刷哪个benchmark重要。摘要里提到的NEO-unify架构、8B dense和30B-A3B两个MoE变体、加上VLA和世界模型方向的「初步证据」——听起来都对,但仅凭摘要无法判断它和前面那一系的真正差别在哪、表征空间是不是真的合一了。157个upvote说明社区在等一个可信的统一方案,但热度不等于结论。

原文:SenseNova-U1: Unifying Multimodal Understanding and Generation with NEO-unify Architecture

也值得关注

今日观察

把今天的δ-mem、Mela、LongMemEval-V2、NanoResearch四篇放在一起看,会发现它们指向的不是「memory又热了」这种trend,而是一个更具体的方法论位移:行业默认的「扩context窗口、攒更多KV cache」路线,正在被「设计一个状态机」路线挑战——问题从「能记多少token」变成「存什么、怎么更新、怎么蒸馏」。δ-mem在架构层把固定大小状态矩阵外挂到frozen backbone上;Mela在test-time动力学层用consolidation把瞬时经验固化为稳定表征;LongMemEval-V2在评测层把目标从「记user history」挪到「记环境/接口/失败模式」;NanoResearch在agent层把memory和skill、policy绑成协同进化的整体——四个层面正好把「状态机记忆」这条路线从底层架构到上层应用撑起来。cache越攒越大不是答案,状态怎么设计才是问题。

具体可以做的事:如果你正在做长上下文或long-running agent,先盘点一下当前KV cache的增长曲线和实际命中模式,区分「真正需要长期保留的状态」和「被cache无差别堆积的中间结果」——前者尝试放进类似δ-mem的紧凑状态结构,后者按相关性(参考CausalCine的CAMR思路)而非时间淘汰,往往比单纯扩窗口能拿到更稳定的长程效果。